インディーミュージックビデオテンプレートに最適なAIスキルで25,000ドルの仕事を週末に収める

従来のインディーミュージックビデオは、安価なもので5,000ドルから、シネマティックなものになるとすぐに50,000ドルを超えます。 ミュージックビデオテンプレート向けのAIスキルは、これを週末、ラップトップ、そしてVibe Skillsのサブスクリプションに圧縮します。以下のスキルは Vibe Skills にあり、2026年にストリームを動かす4つのフォーマット、つまり歌詞ビデオ、ビジュアライザー、ナラティブクリップ、パフォーマンスエディットを提供します。

インディーアーティストはこれまで以上に多くの音楽をリリースしています(2025年には1日に120,000曲以上がSpotifyにヒットします)が、リリースをキャンペーンに変えるビジュアルレイヤーは、ほとんどのアーティストが持てない制作予算の壁に阻まれています。AIミュージックビデオスキルがこのギャップを埋めます。

なぜAIが2026年にインディーのためのミュージックビデオ制作を制覇したのか

従来のミュージックビデオのコスト構造は過酷です。ディレクター、DP、照明、グリップ、出演者、ロケーション、カラー、編集、VFX。友人から借りたミラーレスカメラで撮影した「DIY」インディービデオでさえ、全員に食事とガソリン代を払うと1,500ドルから3,000ドルになります。レーベルグレードのナラティブビデオは25,000ドルから80,000ドルです。

2025年後半に3つの変化がありました。

- Runway Gen-4 と Sora 2 は、8秒から12秒のクリップ全体でキャラクターとシーンの一貫性を維持できるため、3分間のフルビデオに stitched するのに十分な長さです。

- Pika 2.2 は、AIミュージックビデオの取引を壊していたリップシンクとビート認識の動きを追加しました。

- ElevenLabs Sound Design v3 は、SunoまたはUdioの音楽トラックとビートごとに同期したフォリーとアンビエントレイヤーを生成します。

その結果、18ヶ月前には20,000ドルの制作に見えたビデオを、1つのVibe Skillsサブスクリプションを持つアーティストが提供できるようになりました。ボトルネックはもはやレンダリング品質ではなく、ワークフローの知識です。

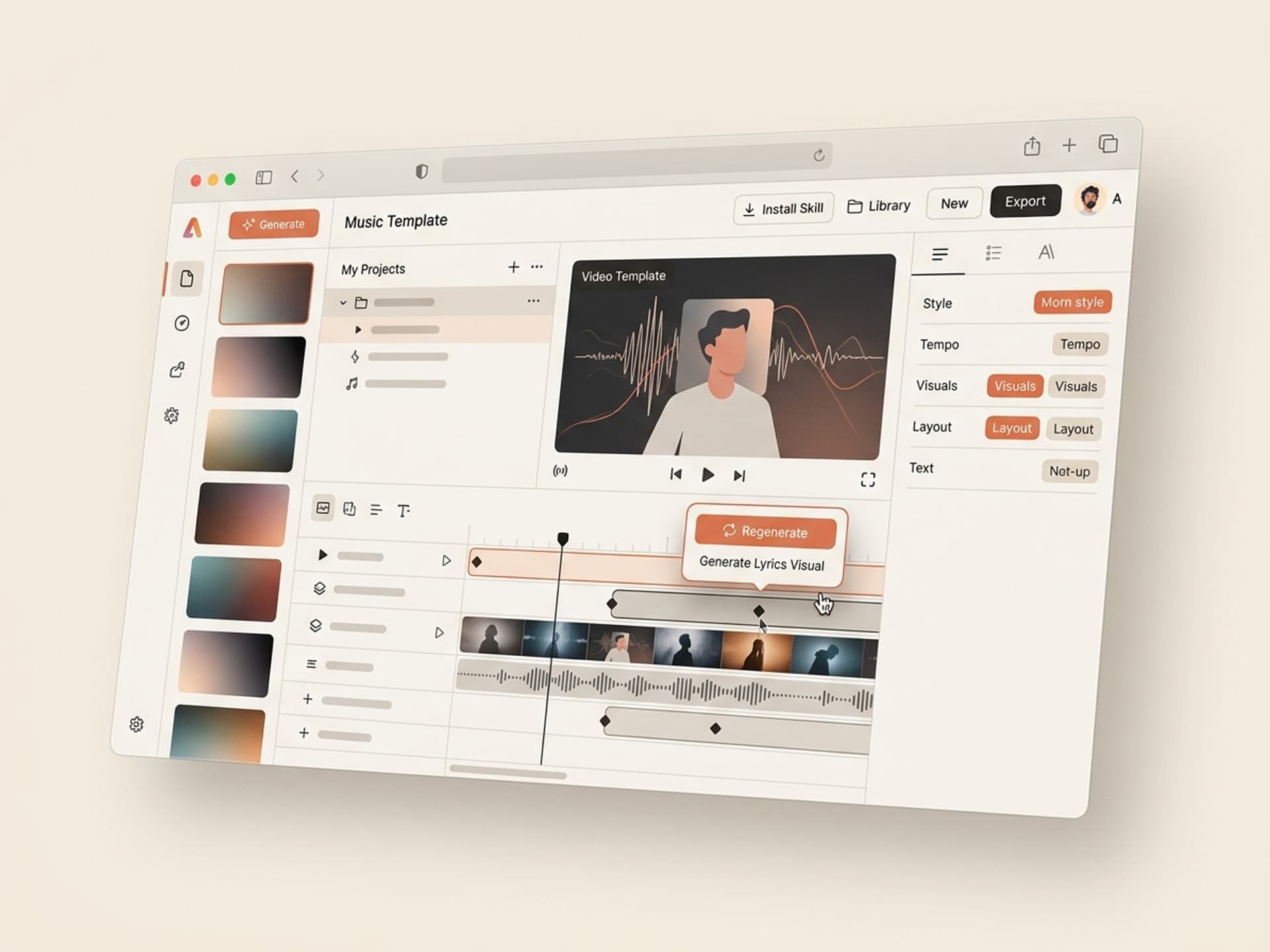

まさにAIスキルがパッケージ化しているものです。ワークフロー、モデルのオーケストレーション、ブランドと美的ルール、およびエクスポートプリセットです。トラックとストーリーをドロップするだけで、スキルが残りを処理します。

インディーアーティストが実際にリリースする4つのミュージックビデオフォーマット

すべてのトラックにBeyonceレベルのナラティブビデオが必要なわけではありません。SpotifyとYouTubeで一貫して成長しているインディーアーティストは、リリースごとにこれらの4つのフォーマットのミックスをリリースしています。

| フォーマット | 使用時期 | 制作時間(AIスキル) | ユースケース |

|---|---|---|---|

| 歌詞ビデオ | すべてのリリース | 30-45分 | YouTube SEO、Spotify Canvas対応、ミュートオートプレイのキャプション |

| ビジュアライザー | アルバムドロップ、EPカット、ディープトラック | 15-25分 | Spotify Canvas(8秒ループ)、TikTok背景、Apple Motionアートワーク |

| ナラティブビデオ | リードシングル、時代を定義するトラック | 4-8時間 | YouTubeのヒーロービデオ、プレス報道、フェスティバルの sizzle |

| パフォーマンスエディット | ライブ録音、アコースティックバージョン、舞台裏 | 1-2時間 | YouTubeのセカンダリコンテンツ、ファンエンゲージメント、アルゴリズムフィード |

スマートなリリース戦略は、シングルごとに1つのナラティブビデオ、プロジェクトの他のすべてのトラックごとに3〜5の歌詞ビデオ、Spotify Canvasスロットごとに1つのビジュアライザー、そしてYouTube ShortsとReels向けのパフォーマンスエディットの継続的なストリームです。これを手動で行うと、アルバムあたり30,000ドル以上かかります。AIスキルを使用すると、Proサブスクリプションの予算内に収まります。

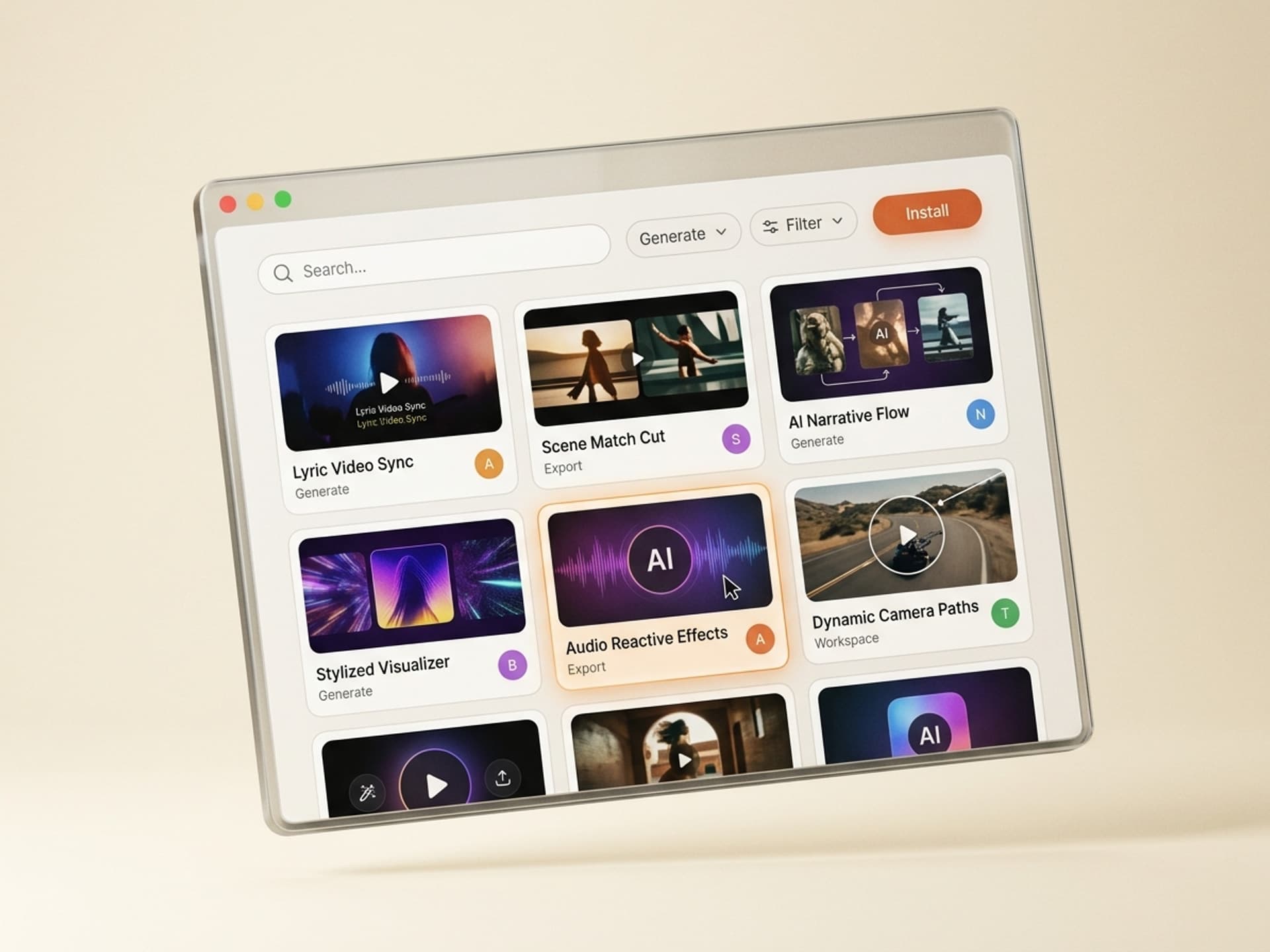

Vibe Skillsの5つのAIミュージックビデオスキル

これらの5つのスキルは、インディーミュージックビデオのスタックをエンドツーエンドでカバーしています。それぞれにスタイル参照、ビート検出プリセット、YouTube、Spotify Canvas、およびショートフォーマットの垂直方向のエクスポートプロファイルが付属しています。

1. 歌詞ビデオビートシンク

オーディオファイルと歌詞から完全な歌詞ビデオを生成します。歌詞が提供されていない場合は自動的に文字起こしし、トラックをビート検出して、ボーカルフレーズと同期して歌詞をアニメートします。ブランドカラーとフォントコントロールを備えた16:9、9:16、および1:1で出力します。

最適: すべてのリリース。デフォルトの歌詞ビデオは、曲がDSPにヒットする前に実行されている必要があります。

2. Spotify Canvasループジェネレーター

SpotifyのCanvas仕様(9:16、720x1280、8MB未満)に合わせた8秒のシームレスループを作成します。単一のスタイル参照画像とトラックセクションを取り込み、カバーアートに対してビートマッチングとカラーグレーディングを行うループを生成します。実行ごとに3つのバリアントを提供するので、アーティストはSpotify for Artists内でA/Bテストできます。

最適: すべてのリリース、すべてのトラック。Canvasは、保存とプレイリスト追加の測定可能な増加を促進します。

3. ナラティブミュージックビデオディレクター

曲、1段落のストーリー概要、およびキャラクター参照を受け取り、3分間のナラティブビデオを18〜24ショットでストーリーボード化します。Runway Gen-4またはSora 2を使用して各ショットを生成し、キャラクターの一貫性をロックします。ショット、トランジション、およびビート同期編集ガイドを備えたPremiereまたはDaVinci対応のビンを返します。

最適: YouTubeのヒーローアセットがメジャーと競争することを望むリードシングルおよび時代をローンチするトラック。

4. パフォーマンスビジュアライザー

単一のパフォーマンス写真または短いクリップを、ビートに合わせてパルスするリアクティブ要素を備えたスタイリッシュなビジュアライザーに変換します。12のビジュアルスタイルプリセット(アナログVHS、アニメ、ドリームコア、グリッチ、キネティック、ヴィンテージフィルムなど)が含まれているため、同じスキルがアルバムサイクル全体で一貫したシリーズを生成します。

最適: アルバムカットとディープカタログ。ナラティブビデオよりも出荷コストが低く、静的カバー画像ループよりも説得力があります。

5. ライブセッションカットエディター

ライブセッションの生のマルチカメラフッテージ(または単一の電話クリップ)を取り込み、アーティストの定義したビジュアルスタイルでクリーンなパフォーマンスビデオを編集します。音楽フレーズにカットを自動同期させ、カラーグレード、下部サード、およびプラットフォーム固有のエクスポートを適用します。ローファイソースで動作するため、iPhoneで撮影したアコースティックセッションは、公開可能なTiny Deskスタイルのクリップになります。

最適: YouTubeのセカンダリコンテンツ、毎週のアーティストチャンネルアップロード、リリース間のオーディエンス構築。

| スキル | 最適 | 閲覧 |

|---|---|---|

| 歌詞ビデオビートシンク | すべてのシングル、歌詞SEO | /category/video |

| Spotify Canvasループジェネレーター | すべてのトラック、DSPビジュアル | /category/video |

| ナラティブミュージックビデオディレクター | リードシングル、ヒーロービデオ | /category/video |

| パフォーマンスビジュアライザー | アルバムカット、ディープカタログ | /category/video |

| ライブセッションカットエディター | パフォーマンスコンテンツ、ファンエンゲージメント | /category/video |

カテゴリごとに30以上のビデオスキル。すべてVibe Skillsサブスクリプションに含まれており、$39/月から開始します。

週末のワークフローでミュージックビデオをリリースする

ここでは、インディーアーティストがリリース週のビデオアセットを1回の週末でリリースするために使用する正確なプレイブックを紹介します。

ステップ1:Vibe Skillsで適切なスキルを選択する

Vibe Skillsのビデオカテゴリ を開き、シングルリリースのために必要な4つのスキル、つまりLyric Video Beat Sync、Spotify Canvas Loop Generator、Narrative Music Video Director、Performance Visualizerをインストールします。1つのサブスクリプションでそれらすべてをカバーできます。

ステップ2:ビジュアルワールドを定義する(30分)

3つのスタイル参照、カラーパレット、フォントの選択、および1行のトーンステートメント(「温かい90年代のアナログフィルムグレイン」、「サイバーパンクネオンノワール」、「ミニマリスト白黒キネティック」)を含む1ページのブランドシートを作成します。すべてのスキルはこれを単一のブランド入力として受け取るため、アルバムサイクルのビジュアルはフォーマット全体で一貫性を保ちます。

ステップ3:最初に歌詞ビデオを実行する(45分)

歌詞ビデオはリリース週のセーフティネットです。他に何も間に合わなくても、歌詞ビデオはYouTubeをカバーし、共有できるものを提供します。オーディオをドロップし、歌詞を貼り付け、実行をヒットし、YouTube用に16:9、TikTokとReels用に9:16をエクスポートします。

ステップ4:すべてのトラックのCanvasループを生成する(土曜日の午後)

リリースがフルプロジェクトの場合、すべてのトラックのSpotify Canvasループをバッチ生成します。各ループは15〜25分で実行されます。8トラックのEPは4時間未満で完了します。Spotify for Artistsから直接アップロードします。

ステップ5:ナラティブビデオをディレクションする(土曜日の夜から日曜日の朝)

リードシングルについては、Narrative Music Video Directorを実行します。1段落のストーリー概要を書き、キャラクター参照写真を添付し、実行をヒットします。ストーリーボードを確認し、ヒットしないショットを再生成してから、編集準備完了のビンをエクスポートします。

ステップ6:PremiereまたはDaVinciでナラティブカットを磨く(日曜日の午後)

AIが重い作業を行っても、選択したエディターで30〜60分かけてカットをキックに微調整し、一貫性のためにカラーグレーディングを行い、最終的なオーディオミックスを追加したい場合があります。スキルは事前にカットされたシーケンスを提供するため、これは組み立てではなく、磨きです。

ステップ7:リリース週中のビジュアライザーとパフォーマンスエディット

リリース後、ディープカットのPerformance Visualizerと、ライブまたはアコースティック録音がある場合はLive Session Cut Editorを実行します。これらは、アルゴリズムを温かく保つために、リリース後の4〜6週間にわたって継続的なコンテンツになります。

合計時間:週末で約16時間。総コスト:Vibe Skills Proサブスクリプション$39/月と通常の編集者。

よくある質問

AI生成のミュージックビデオフッテージに著作権問題はありますか?

ほとんどの主要なAIビデオモデル(Runway、Sora、Pika)は、有料プランで生成されたコンテンツの商用利用権を付与します。Vibe Skillsのスキルは、権利のあるモデルAPIを介してルーティングされるため、出力は公開するものです。グレーゾーンはスタイルの模倣です。特定の著作権で保護されたミュージックビデオをショットごとに模倣するようにスキルを指示すると、そのリスクを負うことになります。スキルをディレクターのように扱ってください。オリジナルのクリエイティブなディレクションを提供してください。

Spotify Canvasとフルミュージックビデオ - インディーの成長にとってどちらがより重要ですか?

両方、異なる理由で。CanvasはDSPパフォーマンス(保存、プレイリスト追加、Spotify内での繰り返し再生)を促進します。フルミュージックビデオはYouTubeの発見、プレス報道、ソーシャル共有を促進します。Canvasは、すべての再生の横に存在するため、交渉の余地はありません。フルビデオはキャンペーンの乗数です。編集プレイリストに載るためのプレスヒットを獲得します。すべてのトラックでCanvasを実行し、リリースごとに少なくとも1つのトラックでフルビデオを実行します。Vibe Skillsでビデオスキルを閲覧 して両方を設定してください。

どの音楽ジャンルがAIミュージックビデオスキルに最適ですか?

エレクトロニック、ハイパーポップ、インディーポップ、ローファイ、アンビエント、ベッドルームポップのジャンルは、そのビジュアルコードがすでに抽象的、シュール、スタイリッシュであるため、今日、最もクリーンなAIミュージックビデオ出力を提供します。ヒップホップとR&Bはビジュアライザーと歌詞ビデオには最適ですが、ナラティブフォーマットでは人間の撮影によるパフォーマンスフッテージから引き続き恩恵を受けます。フォークとシンガーソングライターのジャンルは、パフォーマンスビジュアライザーとライブセッションカットエディターのスキルに最適で、人間的な要素が前面に押し出されています。

フルミュージックビデオ全体で一貫したキャラクターを維持できますか?

はい。Vibe SkillsのNarrative Music Video Directorスキルは、キャラクター参照ロックを使用しており、Runway Gen-4またはSora 2を介して生成されるすべてのショットに同じアイデンティティ(顔、髪、衣装、カラーパレット)をフィードします。最初に1つの参照写真をアップロードすると、スキルは3分間のビデオを構成する18〜24ショット全体で一貫性を強制します。ビデオに2人のリードがいる場合、セカンダリキャラクターをロックすることもできます。

フルナラティブミュージックビデオをリリースするにはどのくらい時間がかかりますか?

週末。プリプロダクション(ストーリー概要、キャラクター参照、スタイルシート)は90分ほどかかります。Narrative Music Video Directorを介した生成には2〜4時間のコンピューティング時間が必要で、ほとんどがバックグラウンドで実行されます。PremiereまたはDaVinciでのエディタのポリッシュにはさらに60〜90分かかります。合計アクティブ時間は週末に分散して約4〜6時間です。これを、コンセプトからデリバリーまでの従来のインディーミュージックビデオ撮影にかかる6〜12週間と比較してください。

これはミュージックビデオディレクターを雇うことを置き換えますか?

ほとんどのインディーリリースサイクルでは、はい。物理的なパフォーマンスフッテージ、振付、または特定の物理的な場所が必要な時代を定義するキャンペーンでは、ディレクターは依然として価値を追加します。ほとんどのアーティストが落ち着くパターンは、Vibe Skillsをリリースコンテンツの80%(歌詞ビデオ、Canvas、パフォーマンスビジュアライザー)に使用し、アルバムサイクルあたり1つまたは2つのナラティブビデオのために予算を確保することです。これらは人間のクリエイティブリードを必要とします。フルビデオカテゴリを参照 して、ディレクターなしでリリースできるものを確認してください。

AIミュージックビデオはファンの間で私のインディーの信頼性を損ないますか?

ビジュアルが音楽と一致していれば、損ないません。ファンはクリエイティブな一貫性を気にし、出所を気にしません。「AIスロップ」でからかわれているアーティストは、曲との関係がない、一般的で労力の少ないビジュアライザーをリリースするアーティストです。AIを思慮深く使用するアーティスト(定義されたビジュアルワールド、意図的な美学、一貫したキャラクターワーク)は、編集プレイリストに掲載され、プレス報道を獲得しています。AIはAbletonやDaVinciのような制作ツールです。観客はツールチェーンではなく、出力で判断します。

無料でミュージックビデオをディレクションしてくれる友達に頼むのをやめましょう

2026年のインディーミュージックは、コンテンツ量ゲームです。Spotifyはストリームごとに支払い、YouTubeは視聴ごとに支払い、TikTokは視聴されたオーディオの秒ごとに支払います。勝つアーティストは、より多くをリリースし、リリースごとに多くのビジュアルをリリースし、アルゴリズムフィードに十分な時間留まって複利を得るアーティストです。ビデオあたり5,000ドルでは、そのどれも不可能です。

Vibe Skillsは、インディーアーティストが必要とする4つのミュージックビデオフォーマット(歌詞ビデオ、Canvasループ、ナラティブビデオ、パフォーマンスエディット)を単一のサブスクリプションに収めます。1週末、1つの39ドルのプラン、1つのリリース週のビデオアセット。

Vibe SkillsでミュージックビデオAIスキルを閲覧 →

25,000ドルのディレクターの見積もりをスキップしましょう。Vibe SkillsでミュージックビデオAIスキルをインストール して、この週末にリリース週のビジュアルをリリースしましょう。