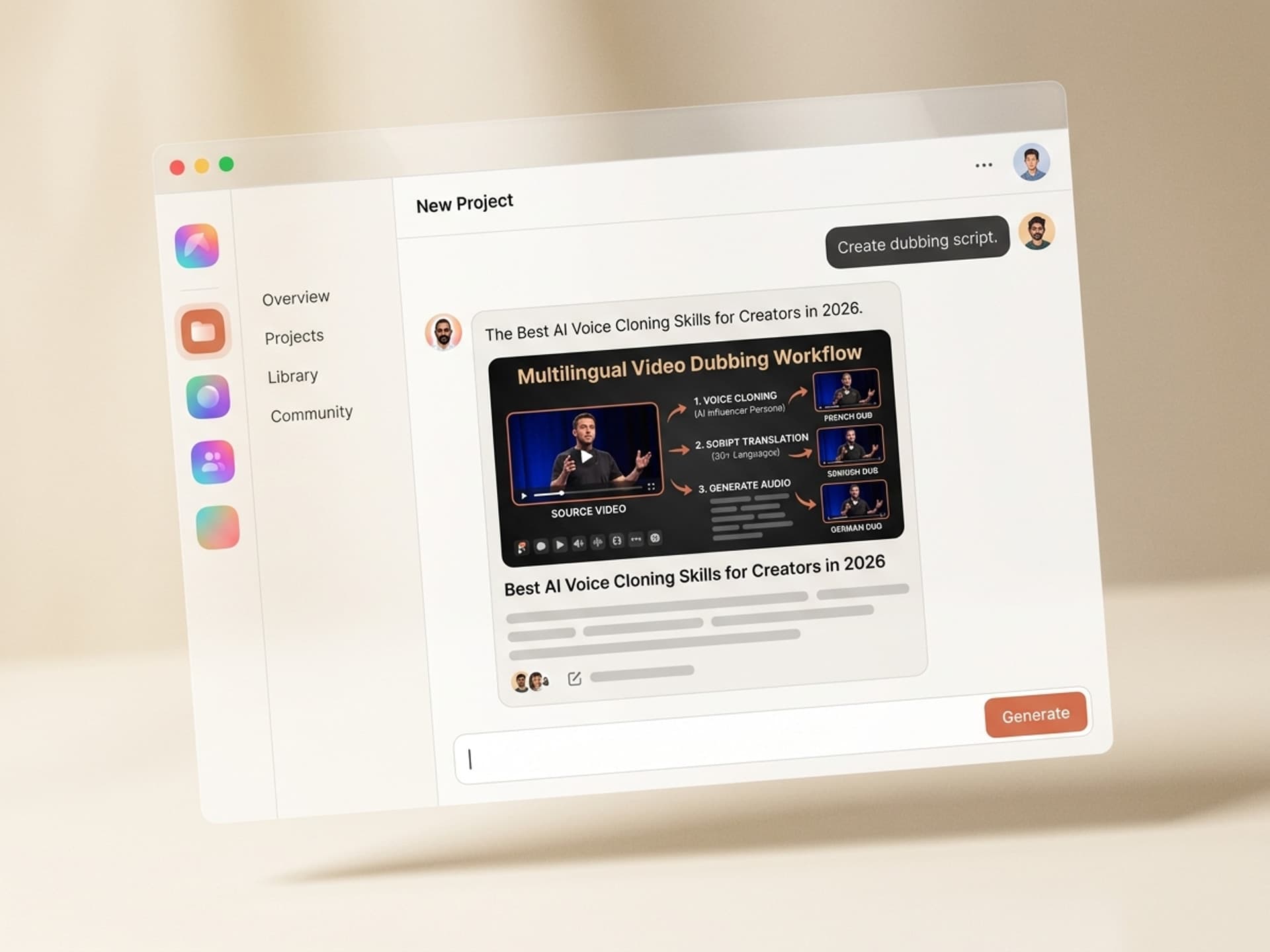

2026年クリエイター向けAI音声クローニングスキル ベストセレクション

AI音声クローニングにより、クリエイターは自身の声の30秒のサンプルを使用するだけで、30以上の言語で公開し、毎日AIペルソナコンテンツを配信し、ポッドキャストを24時間体制の生産ラインに変えることができます。 ElevenLabsは、サブ秒のレイテンシーと70以上の言語で商用市場をリードしていますが、そのワークフロー(ライブラリ設定、吹き替え、ブランドボイスの一貫性、倫理的開示)は5つのツールに分散しています。AI音声クローニングスキルは、パイプライン全体を1つのインストールにパッケージ化し、クリエイターがツールを連携させることから解放され、コンテンツ制作に集中できるようになります。始める最も速い方法は、Vibe Skillsから既成のボイススキルを入手することです。

これはツールのまとめではなく、クリエイターのための実践ガイドです。実際のポッドキャスター、YouTuber、AIペルソナビルダーは、スタジオを雇うことなく、より多くのコンテンツをより多くの言語で配信するためにボイスクローンを使用しており、「早期採用者」と「誰もがやっている」の差は急速に縮まっています。

AIペルソナ成長のボトルネックとなる音声

ほとんどのクリエイターにとって、AIコンテンツのビジュアル面は解決されています。画像とビデオモデルは2025年にフォトリアリスティックな品質に達しました。しかし、ペルソナをリアルに感じさせるのは音声であり、ワークフローが破綻するのも音声です。

ボトルネックは3つの箇所で現れます。

- 制作スピード。 20分間のクリーンなナレーションの録音は、セットアップ、撮り直し、編集を考慮すると、スタジオで60〜90分かかります。これを毎日のShortsに掛け合わせると、週の終わりには時間がなくなります。

- 言語リーチ。 英語しか話せないクリエイターは、TAM(Total Addressable Market)を約15億人に限定します。10言語での吹き替えオーディオがあれば、その数は50億人以上の潜在的な視聴者に跳ね上がります。YouTubeは2024年後半から多言語オーディオトラックに力を入れており、MrBeastの吹き替えチャンネルは、彼の英語チャンネルよりも多くの視聴回数を集めています。

- ペルソナの一貫性。 AIペルソナには、3ヶ月前と同じように火曜日にも聞こえる声が必要です。毎日のAIキャラクターのために声優を雇うと、セッションあたり300〜800ドルかかり、彼らが病気になったり、料金を値上げしたりすると、すぐに破綻します。

ElevenLabsは、2024年だけでプラットフォーム上で250万もの音声がクローンされたと報告しています。市場は2032年までに54億ドルに達し、年平均成長率26%で成長すると予測されています。理由は単純です:音声クローニングは、オーディオ制作コストを「スタジオセッション」から「APIコール」に圧縮しながら、ブラインドテストでは人間と区別がつかない出力を維持します。

欠けているのは、モデルの上に構築されるワークフローレイヤーであり、それがAIスキルの出番です。

クリエイター向けの音声クローニングユースケース

音声クローニングは単一の機能ではありません。一緒に実行すると複利効果を発揮するユースケースのスタックです。2026年にクリエイターが実際に収入を得ているのは以下の分野です。

| ユースケース | 代替するもの | 節約時間 |

|---|---|---|

| 多言語ビデオ吹き替え | 人間のスタジオで言語あたり1時間あたり2,000〜5,000ドル | 10分間のビデオを30分未満で8言語に翻訳・吹き替え |

| AIペルソナナレーション | 声優セッションあたり300〜800ドル、毎日のコンテンツで年間30,000ドル以上 | 1回の午後にAIペルソナReelsの30日分を配信 |

| ポッドキャストアシスタントボイス | 2人目のホストまたはプロデューサー(年間50,000ドル以上) | オンデマンドでイントロ、アウトロ、広告読み、セグメント遷移を生成 |

| オーディオブック + コースナレーション | フリーランスナレーターで完成1時間あたり200〜400ドル | 6時間のコースを1回のバッチレンダリングでナレーション |

| ニュースレター音声版 | 音声のスキップ(ほとんどのクリエイターが実施) | すべてのニュースレター投稿からポッドキャストフィードを自動生成 |

| ライブイベントのパーソナライゼーション | 一般的な録音済みボイスメッセージ | 自分の声で参加者1,000人にパーソナライズされた音声メッセージを送信 |

2番目のユースケースで経済性が逆転します。吹き替えのみを行うクリエイターはすぐに損益分岐点に到達します。同じ音声ライブラリで吹き替え+ペルソナ+ポッドキャスト+コースナレーションを実行するクリエイターは、1回のShortsサイクルでAIスタック全体を回収します。

課題は技術的なものではなく、運用的なものです。ほとんどのクリエイターは、ElevenLabs + 翻訳ツール + ビデオエディタ + ポッドキャストプラットフォームを手動で連携させようとし、2週間後に断念します。AIスキルがそれを解決します。

Vibe SkillsでAIインフルエンカースキルを閲覧 →

2026年の音声クローニングツールの状況

スキルのおすすめが理にかなうように、基盤となるツールの簡単な背景情報です。クリエイターはこれらすべてを学ぶ必要はありません。スキルがそれらをラップします。

| ツール | 最適 | 言語 | ボイスクローン品質 |

|---|---|---|---|

| ElevenLabs | 最高忠実度、ポッドキャストおよびペルソナワーク | 70以上 | 業界リーダー。30秒からのインスタントクローン、30分からのプロフェッショナルクローン |

| Descript Overdub | 既存の録音の編集、ポッドキャストのクリーニング | 英語中心 | 修正には適しているが、完全な生成には弱い |

| OpenAI Voice Engine | 会話型AI、長尺応答 | 50以上 | 高品質、アクセス制限あり(ウェイティングリスト) |

| Google Vertex AI / Chirp | エンタープライズ吹き替え、YouTube自動吹き替え | 100以上 | アクセント転送に強い、感情的なニュアンスには弱い |

| Resemble AI | リアルタイム音声クローニング、ゲーム、NPC | 60以上 | 強力なリアルタイムAPI、インタラクティブ製品で使用 |

ElevenLabsは2026年のクリエイターにとってデファクトスタンダードです。 2025年にサブ300msのレイテンシーを達成し、30秒のサンプルからの音声クローニングをサポートし、現在では話者の声を言語間で維持するネイティブ多言語吹き替えを提供しています。マーケットプレイスのAI音声クローニングスキルのほとんどは、ElevenLabsをプライマリエンジンとして使用し、ワークフローレイヤーを追加しています。

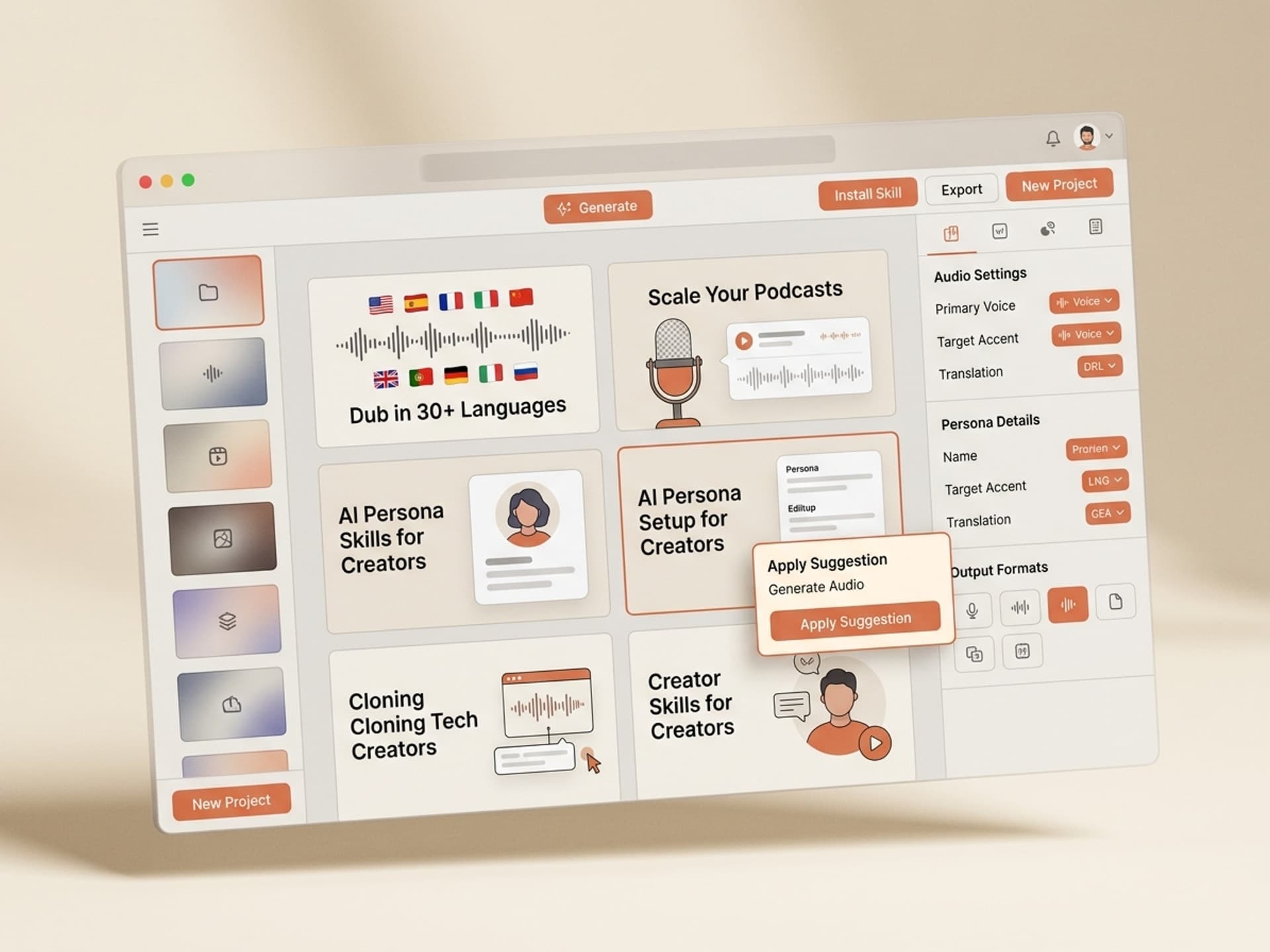

Vibe Skillsの5つのAI音声クローニングスキル

これらはそれぞれパッケージ化されたワークフローであり、単なるセットアップチェックリストではありません。1つインストールし、音声サンプルを接続し、配信します。

| スキル | 最適 | 内容 |

|---|---|---|

| 多言語ビデオダブバー | YouTuber、コースクリエイター、ソーシャルビデオ | ソース言語の自動検出、翻訳、クローンされた声での30以上のターゲット言語への吹き替えトラック生成、リップシンクオプション |

| AIペルソナナレーターキット | AIインフルエンサービルダー、バーチャルモデルクリエイター | 完全な音声ライブラリ設定、ブランドボイスルール、イントロ/アウトロ/フックテンプレート、コンテンツカデンスプリセット |

| ポッドキャストAI共同ホスト | ポッドキャスター、ニュースレター音声クリエイター | クローンされた声 + コンテンツブリーフ入力、広告読み、セグメント遷移、エピソード概要、ソーシャルプルクォートを生成 |

| オーディオブック + コースナレーター | コースクリエイター、インディー作家、教育者 | 一貫したペースでの長尺スクリプトのバッチナレーション、章区切り検出、専門用語の発音ライブラリ |

| ボイスアイデンティティキット | ソロクリエイター、フリーランサー、創業者 | クローンされた声 + ブランドボイスルール + 50の再利用可能なオーディオスニペット(CTA、イントロ、ボイスメール、ソーシャルフック)を設定 |

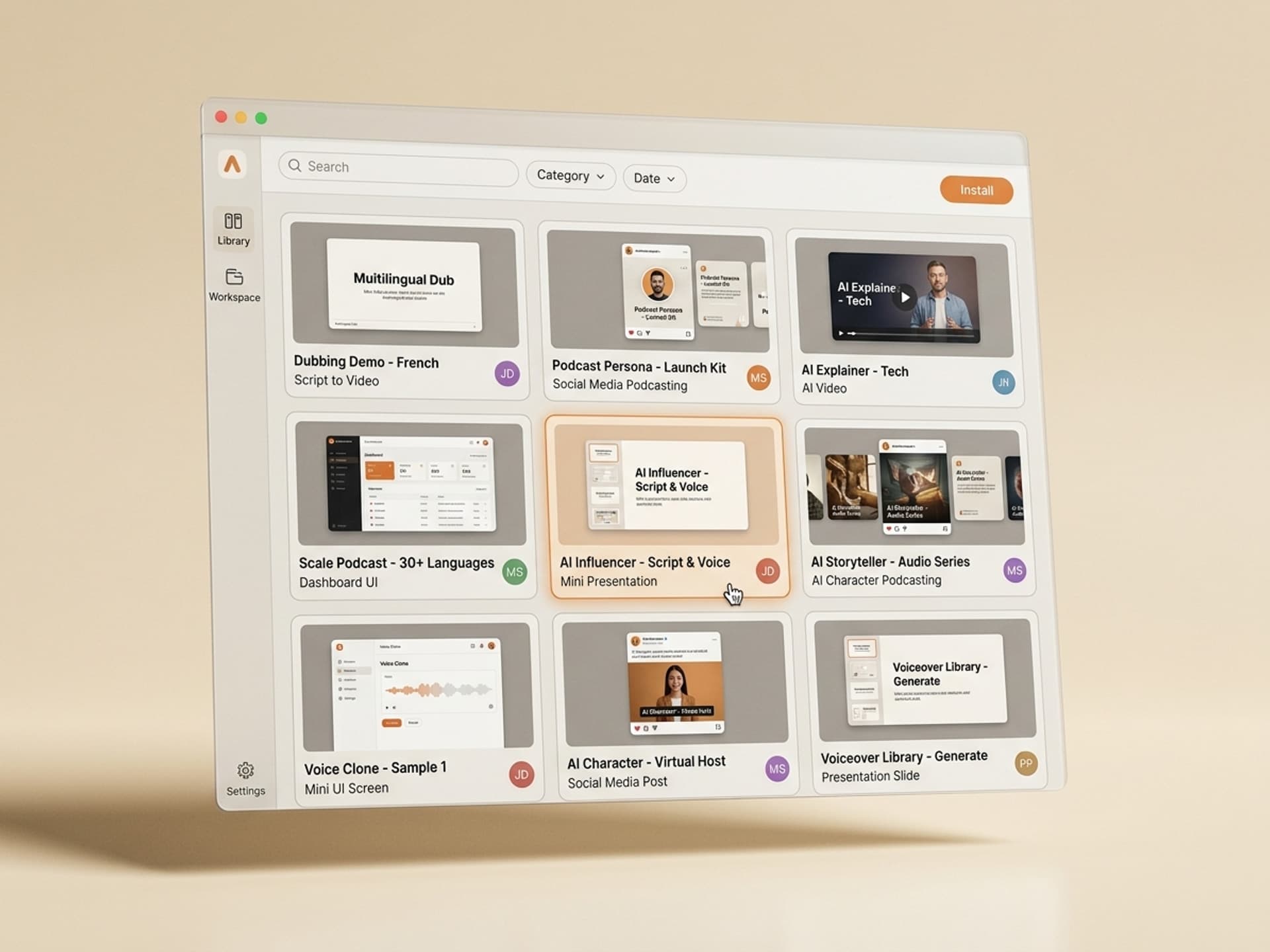

これら5つすべてが、Vibe SkillsのAIインフルエンサーカテゴリに、完全なアイデンティティキット(顔、声、コンテンツピラー)と共に存在します。サブスクライバーは無制限のスキルをインストールできるため、ほとんどのクリエイターはペルソナのために2〜3個をスタックします。

Vibe SkillsでAIインフルエンカースキルを閲覧 →

30分で声をクローン(ステップバイステップ)

これが実際のワークフローです。初回は倫理的設定を含めて、エンドツーエンドで30分未満です。

ステップ1:Vibe Skillsで適切なスキルを選択

AIインフルエンサーカテゴリを開き、ユースケースに合ったワークフロー(ゼロから始める場合はVoice Identity Kit、既にビデオを公開している場合はMulti-Language Video Dubber)を選択してインストールします。各スキルには、セットアップチェックリスト、ElevenLabsの設定、ブランドボイステンプレートが付属しています。

ステップ2:音声サンプルを録音

迅速なクローンには30秒のクリーンなオーディオ、プロフェッショナルなクローンには30分が必要です。静かな部屋でUSBマイク(79ドルのSamson Q2Uで十分)で録音します。自然に話しましょう。段落を読み、90秒の物語を話し、次に5つの異なる感情表現(興奮、冷静、真剣、フレンドリー、好奇心)で録音します。

ステップ3:音声のアップロードとトレーニング

スキルはElevenLabsの音声作成プロセスを案内します。迅速なターンアラウンドのためのインスタントクローン、最高忠実度のためのプロフェッショナルクローン。トレーニングは30秒(インスタント)から数時間(プロフェッショナル)かかります。ライブラリを整理するために、声を明確に名前を付けます。「Elena Brand Voice 2026」。

ステップ4:ブランドボイスルールの設定

これはすべてのクリエイターがスキップし、すべてのクリエイターが後悔するステップです。スキル内で、ブランドボイス仕様を入力します。ペース(遅い/自然/エネルギッシュ)、トーン(温かい、権威的、遊び心)、許可またはブロックするフィラーワード、製品名の発音ルール。スキルはこれらのルールを保存し、すべてのレンダリングに適用します。

ステップ5:最初の資産を生成

スキルからフォーマットを選択します。吹き替えビデオトラック、ポッドキャストイントロ、AIペルソナReelスクリプト、コースチャプターナレーション。テキストを貼り付け、レンダリングをクリックし、数秒でオーディオファイルを取得します。ほとんどのスキルは、MP3、WAV、または新しいオーディオトラックが埋め込まれたビデオファイルに直接エクスポートします。

ステップ6:開示を追加

AI音声と人間を視聴者が混同する可能性のある出力には、開示を追加します。「このオーディオはクリエイターのAIボイスクローンを使用しています」という開示テンプレートと、推奨される配置(ビデオ説明、ポッドキャストショーノート、ソーシャルキャプション)。これはオプションではありません。倫理セクションを参照してください。

ステップ7:配信と再利用

レンダリングされたファイルをライブラリに保存します。スキルはバージョン管理された履歴を保持するため、同じスクリプトを新しい言語で再レンダリングしたり、声を切り替えたり、音声設定を失うことなくスクリプトを更新したりできます。ほとんどのクリエイターは、NotionまたはFrame.io内に「ボイスライブラリ」を設定し、すべてのキャンペーンでそこからプルします。

倫理、同意、開示(誰もがスキップする部分)

音声クローニングは、現在AIにおいて最も倫理的に負荷の高いカテゴリです。3つのルールを守れば、トラブルを避け、プラットフォームポリシー、規制当局、そして視聴者の正しい側にいられます。

自身の声のみをクローンしてください。 または、クローンする人の声から明示的かつ書面による同意を得てください。FTCは2024年、非同意の音声クローニングでAI音声サービスメーカーに2500万ドルの罰金を科しました。EU AI法は、非同意の音声クローンをハイリスクシステムに分類しています。ポッドキャストのゲスト、同僚、お気に入りのYouTuberは、署名されたリリースなしでは、誰もが利用できるわけではありません。

AI生成オーディオを開示してください。 ビデオ説明、ポッドキャストショーノート、またはソーシャルキャプションに明確な注意書きを追加します(「クリエイターのAIボイスクローン」)。YouTubeの責任あるAIラベリングルールは2024年に施行され、実際の人物と誤解される可能性のある合成音声に適用されます。MetaとTikTokは現在AIオーディオを自動検出してラベル付けしていますが、自分でやる方がプラットフォームに任せるよりも信頼性が高く見えます。

決して実在の人物、特に著名人を模倣しないでください。 皮肉、広告、またはペルソナコンテンツのために、政治家、有名人、または実在の第三者をクローンすることは、テイクダウン、名誉毀損訴訟、またはそれ以上のことへの近道です。2024年のFCCの決定により、クローンされた政治的音声を悪用したAI生成ボイスコールは米国で違法となりました。それに近づかないでください。

良いニュース:Vibe Skillsのすべての正規の音声クローニングスキルは、同意検証、開示テンプレート、およびプラットフォームポリシーの整合性をワークフローに組み込んでいます。それがあなたが支払っているものの一部です。

よくある質問

クリエイターにとってAI音声クローニングは合法ですか?

はい - 自身の声のみをクローンするか、話者から書面による同意を得ている限り合法です。公人または第三者の同意なしのクローニングは、ほとんどの法域で違法であり、すべての主要プラットフォームの利用規約に違反します。Vibe Skillsのスキルには、コンプライアンスを維持するための同意テンプレートと開示ガイダンスが付属しています。

2026年、AI音声クローニングの品質は人間と比べてどうですか?

ElevenLabsとVertex AI Chirpからのトップティアのボイスクローンは、短尺オーディオでは80%以上の識別不能率でブラインドテストを通過します。長尺(中断なしで30分以上)では、人間のナレーションは感情的なニュアンスと息継ぎのコントロールにおいてまだわずかに優れていますが、その差は四半期ごとに縮まっています。ほとんどのクリエイターのユースケース(Reels、Shorts、ポッドキャストイントロ、吹き替え)では、AIの品質は十分であり、視聴者は気づきません。

ポッドキャストに音声クローニングを使用できますか?

はい、そしてそれは最もROIの高いユースケースの1つです。広告読み、エピソードイントロ、アウトロ、セグメント遷移、プルクォートにクローンされた声を使用し、メインのインタビューコンテンツには自分の声を使用します。一部のクリエイターは、完全なAI共同ホストを使用しています。Vibe SkillsのPodcast AI Co-Hostスキルは、音声クローン、ブリーフ入力、自動化されたセグメント、およびポッドキャストホストへの直接エクスポートといった、スタック全体を処理します。

音声クローニングワークフローの実行にはいくらかかりますか?

ElevenLabsの価格は、ホビー用途で月額5ドルから、ほとんどのプロクリエイターが使用するクリエイターティアで月額99ドルまであります。ProプランのVibe Skillsサブスクリプションは月額39ドルで、無制限の音声クローニングスキルとその他のカタログ全体が含まれます。作業するクリエイターの総スタックコストは150ドル/月未満です。これを2,000ドル以上のフリーランスの吹き替えセッションと比較すると、その差は歴然です。

私の視聴者は私がAI音声を使用していることを気にしますか?

ワークフローが適切に設定されていれば、ほとんどの人は気づきません。視聴者は、次の3つのことに順番に注意を払います。コンテンツは良いか、クリエイターは本物か、開示はあるか。AI音声を開示すれば、信頼を維持できます。それを隠すと、発見された瞬間に視聴者を失います。2025年の調査では、視聴者は隠されたAIの使用を、開示されたAIの使用よりも3倍厳しく罰するという結果が出ています。

音声クローニングとAIボイスオーバーの違いは何ですか?

AIボイスオーバーは、ストックボイス(ElevenLabs、OpenAI TTS、Google Cloud TTS)のライブラリからボイスを使用します。音声クローニングは、サンプルからあなたの声(または同意する話者の声)でオーディオを生成します。ブランドの一貫性においては、音声クローニングが優れています。一度きりの一般的なナレーションには、ストックAIボイスオーバーで十分であり、わずかに安価です。

YouTube動画を自分の声で他の言語に吹き替えできますか?

はい - これが2026年の最重要ユースケースです。Vibe SkillsのMulti-Language Video Dubberスキルは、ソースビデオを取得し、音声を文字起こしし、ターゲット言語に翻訳し、30以上の言語でクローンされた声の吹き替えトラックを生成します。YouTubeの多言語オーディオ機能を使用すると、すべてのトラックを1つのビデオにアップロードできるため、各視聴者は自動的に自分の言語で音声を聞くことができます。

結論:音声は新しい流通チャネル

2026年、音声クローニングを使用していないすべてのクリエイターは、主要な流通チャネルを逃しています。多言語リーチ、毎日のAIペルソナコンテンツ、ポッドキャストのスケーリング、コースナレーション - これらはもはや実験的なものではありません。これらは真剣なクリエイターの基準です。

正しい行動は、5つのツールを学び、それらを連携させることではありません。ワークフローをラップする1つのスキルをインストールし、音声サンプルを接続し、配信することです。Vibe SkillsのAI音声クローニングスキルは、ElevenLabsの設定、ブランドボイスルール、吹き替えパイプライン、開示テンプレート、およびエクスポートフォーマットを処理します - だからあなたはオペレーターモードではなく、クリエイターモードに留まります。

Vibe Skillsで音声クローニング+AIペルソナスキルを閲覧 →

スタジオはスキップ。あなたの声で、あらゆる言語で配信。 Vibe SkillsでAI音声クローニングスキルをインストール。