Tirohia ngā rau mahi ā-AI kua oti te whakarite mō Claude, Cursor, me ētahi atu.

Najlepsze umiejętności AI do podglądu produktów AR: Dlaczego 2026 to punkt przełomowy

Najlepsze umiejętności AI do podglądu produktów AR w 2026 roku generują model USDZ Apple Quick Look + GLB Android Scene Viewer z kilku zdjęć produktów, umieszczają przycisk podglądu na Twojej stronie produktu i zastępują niestandardowe rozwiązanie AR za 10 000 - 50 000 USD. To, co kiedyś było 6-tygodniowym projektem agencyjnym, teraz można zrobić w piątkowe popołudnie z subskrypcją Vibe Skills.

IKEA Place uruchomiona w 2017 roku udowodniła, że AR może sprzedawać meble. Sephora's Virtual Artist udowodniła, że może sprzedawać kosmetyki. Warby Parker udowodnił, że może sprzedawać okulary. W 2026 roku każda kategoria związana z "dopasowaniem", "rozmiarem" lub "wyglądem w przestrzeni" będzie działać w ten sam sposób - a Apple Quick Look + Android Scene Viewer oznaczają, że nie potrzebujesz już aplikacji do wdrożenia.

Ten przewodnik omawia pięć umiejętności podglądu produktów AR, które polecamy w Vibe Skills w 2026 roku, co każda z nich oferuje i jak wdrożyć rzeczywisty WebAR na Twoich stronach produktów już dziś.

Tirohia ngā rau mahi ā-AI kua oti te whakarite mō Claude, Cursor, me ētahi atu.

Dlaczego AR napędza konwersję e-commerce w 2026 roku

Podglądy AR wypełniają lukę między "myślę, że to pasuje" a "wiem, że to pasuje". W tej luce powstaje większość zwrotów w e-commerce, a zwroty stanowią najdroższą pozycję w budżecie marek DTC. Matematyka jest brutalna: średnia stopa zwrotów w modzie wynosi 20 - 30%, a w meblarstwie 15 - 25%, a każdy zwrot kosztuje markę od 10 do 50 USD za wysyłkę, magazynowanie i utraconą marżę.

Marki, które wdrożyły podglądy AR, opowiadają spójną historię:

- IKEA Place napędziła 11-krotnie dłuższe czasy sesji w przypadku SKU z obsługą AR w porównaniu do płaskich stron produktów (własne studium przypadku IKEA z 2018 r., nadal cytowane jako numer referencyjny)

- Sephora Virtual Artist odnotowała ponad 200 milionów przymierzeń w ciągu pierwszych 18 miesięcy i przypisuje się jej dwucyfrowy wzrost konwersji w kategorii urody na urządzeniach mobilnych

- Warby Parker zbudował cały swój model wzrostu na wirtualnym przymierzaniu, a następnie rozszerzył działalność na handel detaliczny oparty na tym rozwiązaniu

- Shopify podaje, że sprzedawcy, którzy dodają podglądy AR, odnotowują około 94% wyższą konwersję w przypadku produktów z obsługą AR (raport handlowy Shopify z 2020 r.)

Mechanizm jest prosty. Płaskie zdjęcie produktu prosi kupującego o wyobrażenie sobie produktu w kontekście. Podgląd AR pokazuje kupującemu produkt w jego kontekście, na jego twarzy, w jego salonie, na jego blacie kuchennym. Wyobraźnia to przeszkoda. AR ją usuwa.

Koszt sprawiał, że była to funkcja dostępna tylko dla dużych firm. Niestandardowe rozwiązanie WebAR z niezależnym specjalistą od grafiki 3D kosztuje od 10 000 do 50 000 USD za SKU i zajmuje 4 - 8 tygodni. Umiejętności AI skracają ten czas do jednego popołudnia i jednej subskrypcji, a wynik działa na każdym iPhonie (Quick Look) i prawie każdym Androidzie (Scene Viewer) bez pobierania.

Tirohia ngā rau mahi ā-AI kua oti te whakarite mō Claude, Cursor, me ētahi atu.

Anatomia doskonałego podglądu produktu AR

Działający podgląd AR to nie tylko "model 3D na stronie". Podgląd, który generuje konwersje, dostarcza pięć warstw, a umiejętność AI musi obsłużyć wszystkie pięć, aby kupujący faktycznie kliknął przycisk AR.

| Warstwa | Co robi | Dlaczego jest ważna | Powszechny błąd |

|---|---|---|---|

| Model 3D | Fotorealistyczna siatka + tekstury PBR produktu | Bohater. Musi wyglądać jak prawdziwy przedmiot. | Standardowa generyczna siatka, która nie pasuje do SKU |

| Skala rzeczywista | Model jest skalowany w centymetrach, zakotwiczony do podłoża lub twarzy | Kupujący widzi, jak duży lub mały jest naprawdę | Zła skala = mebel unosi się w powietrzu lub buty wyglądają jak klaunowskie |

| Oświetlenie + cienie | Materiały PBR + mapa środowiskowa + cień kontaktowy | Sprzedaje powierzchnię jako prawdziwy materiał w prawdziwym świetle | Płaskie cieniowanie, które wygląda jak element gry wideo |

| Punkty interaktywne | Punkty na modelu do eksploracji (próbki kolorów, wymiary, cechy) | Pozwala kupującemu zbadać produkt jak w sklepie | Brak punktów interaktywnych, więc AR jest tylko statycznym podglądem |

| Rezerwa sieciowa | Statyczny obrotowy widok 360 dla komputerów stacjonarnych + telefony bez AR | 100% ruchu powinno zobaczyć coś użytecznego | Wyświetlanie "AR nieobsługiwane" bez rezerwy |

Prawdziwa umiejętność AR dostarcza wszystkie pięć warstw. Zła dostarcza model i przycisk.

Format również ma znaczenie. Apple Quick Look czyta .usdz. Android Scene Viewer czyta .glb. Każda umiejętność AR Vibe Skills eksportuje oba z jednego źródła, dzięki czemu wysyłasz jeden przycisk, który działa na iOS i Androidzie.

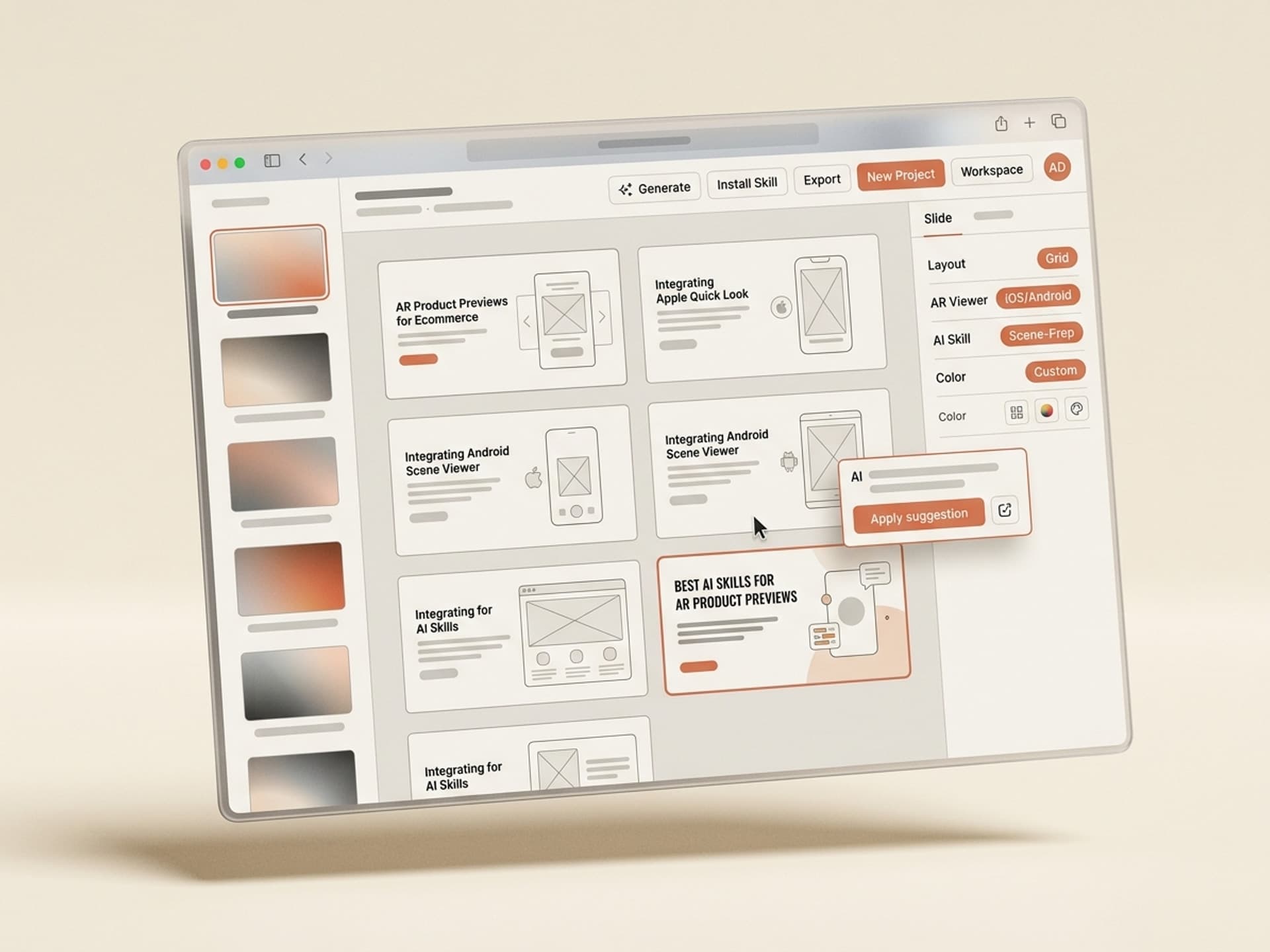

5 umiejętności AI do podglądu produktów AR na Vibe Skills

Oto pięć umiejętności podglądu produktów AR, które polecamy w 2026 roku. Wszystkie znajdują się w kategorii Interaktywne 3D na Vibe Skills i są dostarczane jako komponent sieciowy <ar-button> (zbudowany na <model-viewer>), gotowy do wstawienia do Shopify, WooCommerce, BigCommerce, Webflow lub niestandardowego sklepu Next.js.

1. Umiejętność AR "Meble w pokoju"

Wzorzec IKEA Place. Prześlij 6-12 zdjęć produktu przedstawiających krzesło, sofę, stół lub lampę. Umiejętność generuje model GLB + USDZ klasy fotogrametrycznej, kalibruje skalę rzeczywistą na podstawie wymiarów produktu i dostarcza przycisk "Wyświetl w swoim pokoju", który otwiera Quick Look na iOS i Scene Viewer na Androidzie.

Najlepsze dla: mebli, oświetlenia, dekoracji, artykułów kuchennych, wszystkiego, co jest mierzone w centymetrach.

Wynik: .usdz + .glb + fragment gotowy do Shopify.

Czas wdrożenia: 2 - 4 godziny na SKU.

2. Umiejętność AR "Przymierzanie okularów i okularów przeciwsłonecznych na twarzy"

Wzorzec Warby Parker. Prześlij zdjęcia przodu + boku oprawki. Umiejętność generuje model GLB zakotwiczony na twarzy i wykorzystuje ARKit Face Tracking na iOS + ARCore Augmented Faces na Androidzie, aby w czasie rzeczywistym dopasować okulary do twarzy kupującego. Zawiera kalibrację rozstawu źrenic, dzięki czemu kupujący widzi rzeczywiste dopasowanie.

Najlepsze dla: marek okularów, okularów przeciwsłonecznych, okularów blokujących niebieskie światło. Wynik: moduł AR zakotwiczony na twarzy + rezerwa 360. Czas wdrożenia: 3 - 5 godzin na oprawkę.

3. Umiejętność AR "Przymierzanie sneakersów i butów na stopie"

Śledzenie stopy jest teraz wystarczająco stabilne na iPhone 14+ i Pixel 7+, aby umożliwić przymierzanie butów w WebAR bez aplikacji. Prześlij zdjęcia produktu, a umiejętność wygeneruje model zakotwiczony na stopie i przycisk "Przymierz na swoich stopach". Kupujący kieruje telefon na swoje stopy i widzi sneakersa renderowanego w czasie rzeczywistym.

Najlepsze dla: sneakersów, sandałów, butów na obcasie, botków. Wynik: moduł AR zakotwiczony na stopie + warianty tekstur dopasowanych do marki. Czas wdrożenia: 4 - 6 godzin na styl.

4. Umiejętność AR "Filtr twarzy do makijażu + ust + bez okularów"

Wzorzec Sephora Virtual Artist. Prześlij zdjęcie produktu z pomadką, cieniem do powiek, różem lub podkładem. Umiejętność buduje shader siatki twarzy, który w czasie rzeczywistym mapuje kolor i wykończenie (matowe, błyszczące, metaliczne) na ustach, powiekach lub policzkach kupującego. Działa w przeglądarce, nie wymaga aplikacji.

Najlepsze dla: kosmetyków, produktów do makijażu, produktów do pielęgnacji skóry z widocznym wykończeniem. Wynik: shader siatki twarzy + macierz wariantów odcieni. Czas wdrożenia: 2 - 3 godziny na rodzinę odcieni.

5. Umiejętność AR "Produkt pakowany na blacie"

Niedoceniany koń roboczy. Umieść kawę w opakowaniu, butelkę suplementów, świecę lub perfumy na rzeczywistym blacie w domu kupującego. Umiejętność buduje model GLB dla małych obiektów z etykietami o wysokiej szczegółowości (aby kupujący mógł odczytać tył) i dostarcza przycisk AR do umieszczenia przez dotknięcie.

Najlepsze dla: produktów szybko zbywalnych (CPG), suplementów, perfum, świec, wysokiej jakości żywności i napojów.

Wynik: .usdz + .glb z wbudowanymi etykietami w wysokiej rozdzielczości.

Czas wdrożenia: 90 minut - 2 godziny na SKU.

Przeglądaj wszystkie umiejętności AR + Interaktywne 3D na Vibe Skills →

Jak dodać AR do swojej strony produktu w jedno popołudnie

Oto dokładny przepływ pracy, z którego korzystają nasze najczęściej wdrażane marki DTC do wdrażania AR w całym katalogu. Pięć kroków, od dwóch do czterech godzin na SKU, bez agencji.

-

Wybierz odpowiednią umiejętność AR na Vibe Skills. Dopasuj umiejętność do rodzaju produktu: meble, okulary, sneakersy, kosmetyki lub produkty pakowane. Każda umiejętność dostarcza format i model śledzenia potrzebny dla danej kategorii. Zacznij od kategorii Interaktywne 3D.

-

Prześlij swoje dane wejściowe produktu. Większość umiejętności wymaga 6-12 zdjęć produktu z różnych kątów, rzeczywistych wymiarów w centymetrach oraz wariantów koloru lub wykończenia SKU. Umiejętność automatycznie obsługuje fotogrametrię, czyszczenie siatki i tworzenie tekstur PBR.

-

Zweryfikuj wynik na rzeczywistym urządzeniu. Otwórz wygenerowany plik USDZ na iPhonie (Safari → Quick Look) i plik GLB na Androidzie (Chrome → Scene Viewer). Sprawdź skalę za pomocą prawdziwej linijki. Większość błędów AR w produkcji wynika z tego, że ktoś wdrożył bez sprawdzenia skali.

-

Umieść przycisk AR na swojej stronie produktu. Umiejętność dostarcza fragment kodu

<model-viewer>, który wklejasz poniżej galerii. Sprzedawcy Shopify mogą również korzystać z natywnego blokumodel-viewer. Dodajariar-modes="webxr scene-viewer quick-look", aby ten sam przycisk działał na każdym urządzeniu. -

Śledź zaangażowanie AR w swojej analityce. Wyślij zdarzenie

viewed_in_arpo kliknięciu przycisku AR. Użytkownicy klikający przycisk AR konwertują 2-3 razy częściej niż ci, którzy go nie klikają, więc ten segment jest złotem do retargetingu.

Cały cykl mieści się w jedno popołudnie dla pierwszego SKU, a następnie skraca się do mniej niż 2 godzin na SKU po skonfigurowaniu przepływu pracy.

Często zadawane pytania

Czy podgląd produktu AR to funkcja tylko dla iOS w 2026 roku?

Nie. Apple Quick Look (.usdz) obsługuje iOS, a Android Scene Viewer (.glb) obsługuje Androida. Komponent sieciowy <model-viewer> wysyła jeden przycisk, który wybiera odpowiedni format dla każdego urządzenia. Każda umiejętność AR na Vibe Skills eksportuje oba formaty z jednego źródła, więc wdrażasz raz i działa na około 95% ruchu mobilnego.

Czy potrzebuję natywnej aplikacji do wysyłania podglądów produktów AR?

Nie. WebAR jest domyślnym rozwiązaniem w 2026 roku dla e-commerce. Apple Quick Look i Android Scene Viewer uruchamiają się po kliknięciu w Safari lub Chrome bez instalacji, bez SDK i bez recenzji w App Store. Natywne aplikacje nadal mają sens dla dużych sprzedawców, takich jak IKEA, którzy chcą połączyć lojalność, zapasy i AR w jednym miejscu, ale dla prawie każdej marki DTC WebAR jest właściwym wyborem. Przeglądaj umiejętności gotowe do WebAR, aby wdrożyć bez narzutu natywnego.

Jakiego formatu pliku 3D faktycznie potrzebuję?

Dwa formaty. .usdz dla Apple Quick Look na iOS, .glb dla Android Scene Viewer i <model-viewer>. Są one odpowiednikiem MP4 + WEBM dla wideo w świecie AR. Każda umiejętność AR Vibe Skills eksportuje oba z pojedynczej siatki źródłowej, dzięki czemu nie musisz utrzymywać dwóch potoków. Jeśli dostawca wysyła tylko GLB, Twoi użytkownicy iOS otrzymają niedziałający przycisk AR.

Jak zapewnić prawidłową skalę AR?

Zawsze wprowadzaj wymiary produktu w centymetrach podczas generowania modelu i zawsze testuj na rzeczywistym urządzeniu z prawdziwą linijką przed wdrożeniem. Błędy skali AR są najczęstszym powodem zwrotów podglądów. Umiejętności AR Vibe Skills wbudowują wymiary w metadane GLB + USDZ, dzięki czemu Quick Look i Scene Viewer automatycznie zakotwiczają model w rzeczywistym rozmiarze.

Czy podgląd AR spowolni moją stronę produktu?

Nie musi. Skrypt <model-viewer> ma około 60 KB po skompresowaniu i ładuje się asynchronicznie, a sam plik GLB pobiera się dopiero po kliknięciu przez kupującego "Wyświetl w AR". Ładuj skrypt leniwie za pomocą loading="lazy", a przycisk AR kosztuje około 0 w Largest Contentful Paint. Umiejętności AR Vibe Skills dostarczają domyślnie wzorzec leniwego ładowania, dzięki czemu Twoje Core Web Vitals pozostają zielone.

Ile faktycznie kosztuje podgląd produktu AR w 2026 roku?

Niestandardowe rozwiązanie od freelancerów kosztuje od 10 000 do 50 000 USD za SKU, zajmuje 4-8 tygodni i wiąże Cię z jednym specjalistą. Subskrypcja Vibe Skills kosztuje 39 USD miesięcznie za nieograniczone pobieranie (patrz ceny), a każda umiejętność AR jest wdrażana w ciągu 2-4 godzin. Dla katalogu 50 SKU koszt wynosi około 500 000 USD za pracę freelancerów vs 39 USD za subskrypcję za pierwszy miesiąc produkcji. Subskrypcja wygrywa już przy pierwszym SKU.

Czy mogę używać podglądów AR na Shopify, WooCommerce lub Webflow bez programisty?

Tak. Wynikiem każdej umiejętności AR Vibe Skills jest fragment kodu <model-viewer> oraz pliki modeli. Shopify posiada natywny blok modeli 3D, który akceptuje USDZ + GLB. Webflow akceptuje fragment kodu jako osadzony. WooCommerce + BigCommerce akceptują go jako niestandardowy blok HTML. Nie potrzeba programisty do instalacji, tylko do połączenia analityki (a programista może to zrobić w 20 minut).

Czy AR działa dla produktów, które nie wymagają dopasowania (kubki, świece, artykuły kuchenne)?

Tak - wzorzec AR na blacie jest jednym z najwyżej konwertujących, jakie widzimy, ponieważ kupujący, którzy umieszczają kubek lub świecę w swojej kuchni, sygnalizują zamiar na niemal tym samym poziomie, co kupujący dodający do koszyka. Umiejętność "Produkt pakowany na blacie" w kategorii Interaktywne 3D jest stworzona właśnie do tego zastosowania.

Dlaczego 2026 to rok wdrożenia AR w całym katalogu

Schemat jest ustalony: strony produktów z obsługą AR generują konwersje około 2 razy wyższe niż płaskie strony, AR napędza czasy sesji 3-11 razy dłuższe, a SKU z obsługą AR mają niższe wskaźniki zwrotów, ponieważ kupujący już widzieli dopasowanie. Koszt spadł z 10 000 - 50 000 USD za SKU do jednej subskrypcji Vibe Skills. Format jest ustalony (USDZ + GLB). Przeglądarki go obsługują (Quick Look + Scene Viewer). Sprzęt jest w kieszeniach 95% kupujących.

Pozostało tylko wdrożenie. Marki DTC, które jako pierwsze wkroczą w swojej kategorii, zawładną wynikami wyszukiwania, dowodami społecznymi i punktem odniesienia konwersji przez następne 18 miesięcy.

Przeglądaj umiejętności podglądu produktów AR na Vibe Skills →

Pomiń 6-tygodniową budowę agencyjną. Zainstaluj umiejętność podglądu produktu AR na Vibe Skills i wdróż ją w swoim sklepie już dziś po południu.