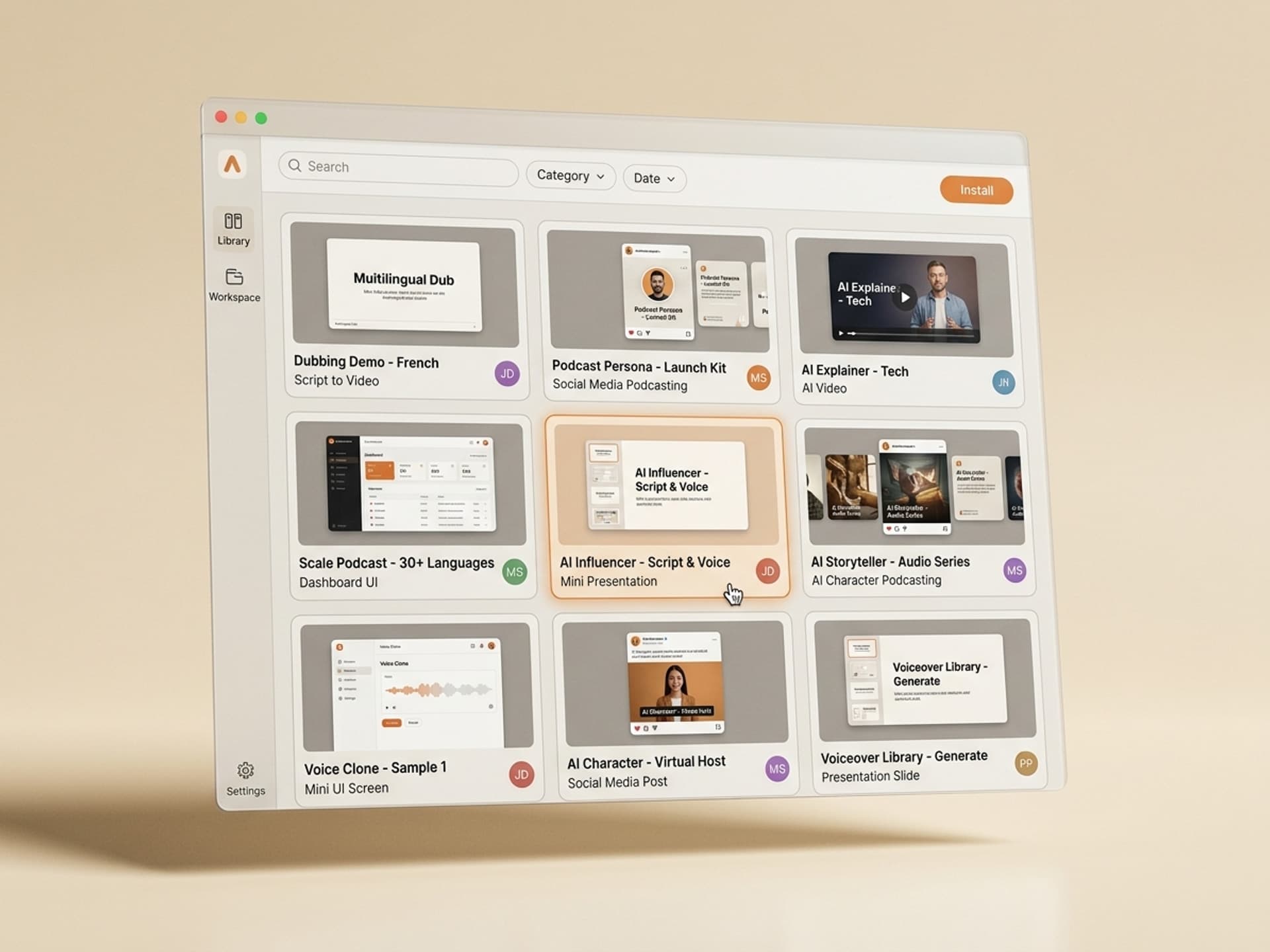

Bla gjennom hundrevis av ferdige ferdigheter for Claude, Cursor og mer.

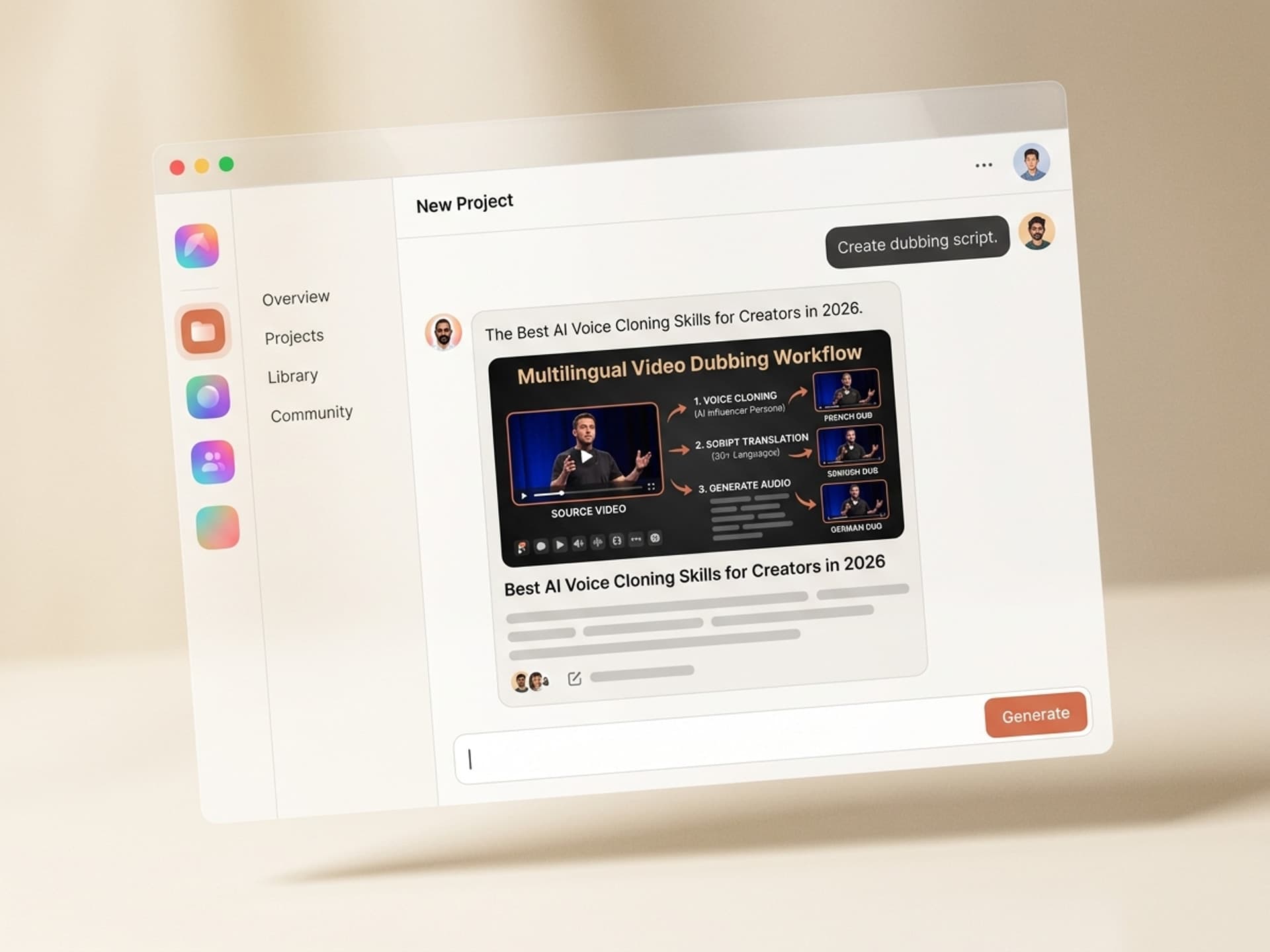

De beste AI-stemmekloningsferdighetene for skapere i 2026

AI-stemmekloning lar en skaper publisere på over 30 språk, levere daglig AI-personainnhold og gjøre en podcast om til en 24/7 produksjonslinje - ved hjelp av en 30-sekunders prøve av sin egen stemme. ElevenLabs leder det kommersielle markedet med under-sekund latenstid og over 70 språk, men arbeidsflyten rundt det (bibliotekoppsett, dubbing, konsistens i merkevarestemme, etisk opplysning) er fragmentert over fem verktøy. AI-stemmekloningsferdigheter samler hele pipelinen i én installasjon, slik at skapere slutter å koble sammen verktøy og begynner å levere. Den raskeste måten å starte på er å skaffe seg en ferdiglaget stemmefærdighet fra Vibe Skills.

Dette er en veiledning for skapere, ikke en oversikt over verktøy. Ekte podkastere, YouTubere og AI-personabyggere bruker stemmekloner for å levere mer innhold på flere språk uten å ansette et studio - og gapet mellom "tidlig adopter" og "alle gjør dette" lukkes raskt.

Bla gjennom hundrevis av ferdige ferdigheter for Claude, Cursor og mer.

Hvorfor stemmen er flaskehalsen for vekst av AI-personaer

For de fleste skapere er den visuelle siden av AI-innhold løst. Bilde- og videomodeller nådde fotorealistisk kvalitet i 2025. Men stemmen er det som får en persona til å føles ekte - og stemmen er der arbeidsflyten bryter sammen.

Flaskehalsen viser seg på tre steder:

- Produksjonshastighet. Å ta opp 20 minutter med ren tale tar 60 - 90 minutter studiotid når man tar hensyn til oppsett, retakes og redigering. Multipliser det med daglige Shorts, og du mister uken.

- Språklig rekkevidde. En skaper som bare snakker engelsk, begrenser sin TAM (Total Addressable Market) til omtrent 1,5 milliarder mennesker. Med dubbet lyd på 10 språk, hopper dette tallet til over 5 milliarder potensielle seere. YouTube har satset hardt på lydspor på flere språk siden slutten av 2024 - MrBeasts dubbede kanaler trekker kollektivt flere seere enn hans engelske kanal.

- Persona-konsistens. AI-personaer trenger en stemme som høres lik ut på tirsdag som den gjorde for tre måneder siden. Å ansette en stemmeskuespiller for en daglig AI-karakter koster $300 - $800 per økt og bryter sammen i det øyeblikket de blir syke eller øker prisene.

ElevenLabs rapporterte 2,5 millioner stemmer klonet på plattformen sin alene i 2024. Markedet er spådd å nå 5,4 milliarder dollar innen 2032, og vokser med 26 % CAGR. Årsaken er enkel: stemmekloning reduserer lydproduksjonskostnaden fra "studiøkter" til "API-kall" samtidig som resultatet er uadskillelig fra menneskelig i blindtester.

Det som mangler er arbeidsflytlaget på toppen av modellen - og det er der AI-ferdigheter kommer inn.

Bla gjennom hundrevis av ferdige ferdigheter for Claude, Cursor og mer.

Bruksområder for stemmekloning for skapere

Stemmekloning er ikke én funksjon. Det er en stabel av bruksområder som forsterker hverandre når du kjører dem sammen. Her er der skapere faktisk tjener penger i 2026:

| Bruksområde | Hva det erstatter | Reell tid spart |

|---|---|---|

| Dubbing av video på flere språk | $2 000 - $5 000 per språk per time med et menneskelig studio | Oversett + dubb en 10-minutters video til 8 språk på under 30 minutter |

| Narration av AI-persona | $300 - $800 per stemmeskuespilløkt, $30K+ per år for daglig innhold | Lever 30 dager med AI-persona Reels på én ettermiddag |

| Podcast-assistentstemme | En annen vert eller produsent ($50K+ per år) | Generer introer, outroer, annonselesninger og segmentoverganger på forespørsel |

| Lydbok + kurs-narration | $200 - $400 per ferdig time for en frilansforteller | Fortell et 6-timers kurs i én batch-gjengivelse |

| Lydversjoner av nyhetsbrev | Å hoppe over lyd helt (de fleste skapere gjør det) | Automatisk generer en podcast-feed fra hvert nyhetsbrevinnlegg |

| Personalisering av live-arrangement | Generiske forhåndsinnspilte taleposter | Send 1 000 personlige lydmeldinger til deltakere med din egen stemme |

Økonomien snur ved det andre bruksområdet. En skaper som bare driver med dubbing, tjener raskt inn investeringen. En skaper som driver med dubbing + persona + podcast + kurs-narration på samme stemmebibliotek, får tilbake hele AI-stakken i en enkelt Shorts-syklus.

Utfordringen er operasjonell, ikke teknisk. De fleste skapere prøver å koble sammen ElevenLabs + et oversettelsesverktøy + en videoredigerer + en podcast-plattform manuelt - og gir opp etter to uker. AI-ferdigheter løser det.

Utforsk AI-influencer-ferdigheter på Vibe Skills →

Verktøylandskapet for stemmekloning i 2026

Kort kontekst om de underliggende verktøyene, slik at ferdighetsanbefalingene gir mening. Skapere trenger ikke å lære seg alle disse - ferdighetene pakker dem inn.

| Verktøy | Best for | Språk | Kvalitet på stemmekloning |

|---|---|---|---|

| ElevenLabs | Høyeste troskap, podcast og persona-arbeid | 70+ | Bransjeleder. Umiddelbar kloning fra 30 sekunder, profesjonell kloning fra 30 minutter |

| Descript Overdub | Redigering av eksisterende opptak, opprydding av podcast | Først og fremst engelsk | Bra for fikseringer, svakere for full generering |

| OpenAI Voice Engine | Konversasjonell AI, langformede svar | 50+ | Høy kvalitet, begrenset tilgang (venteliste) |

| Google Vertex AI / Chirp | Bedriftsdubbing, YouTube auto-dub | 100+ | Sterk på aksentoverføring, svakere på emosjonell nyanse |

| Resemble AI | Sanntids stemmekloning, spill, NPCer | 60+ | Sterk sanntids API, brukt i interaktive produkter |

ElevenLabs er standarden for skapere i 2026. Den nådde under 300ms latenstid i 2025, støtter stemmekloning fra en 30-sekunders prøve, og leverer nå native flerspråklig dubbing som bevarer talerens stemme på tvers av språk. De fleste AI-stemmekloningsferdigheter på markedsplassen bruker ElevenLabs som primærmotor og legger til arbeidsflytlaget.

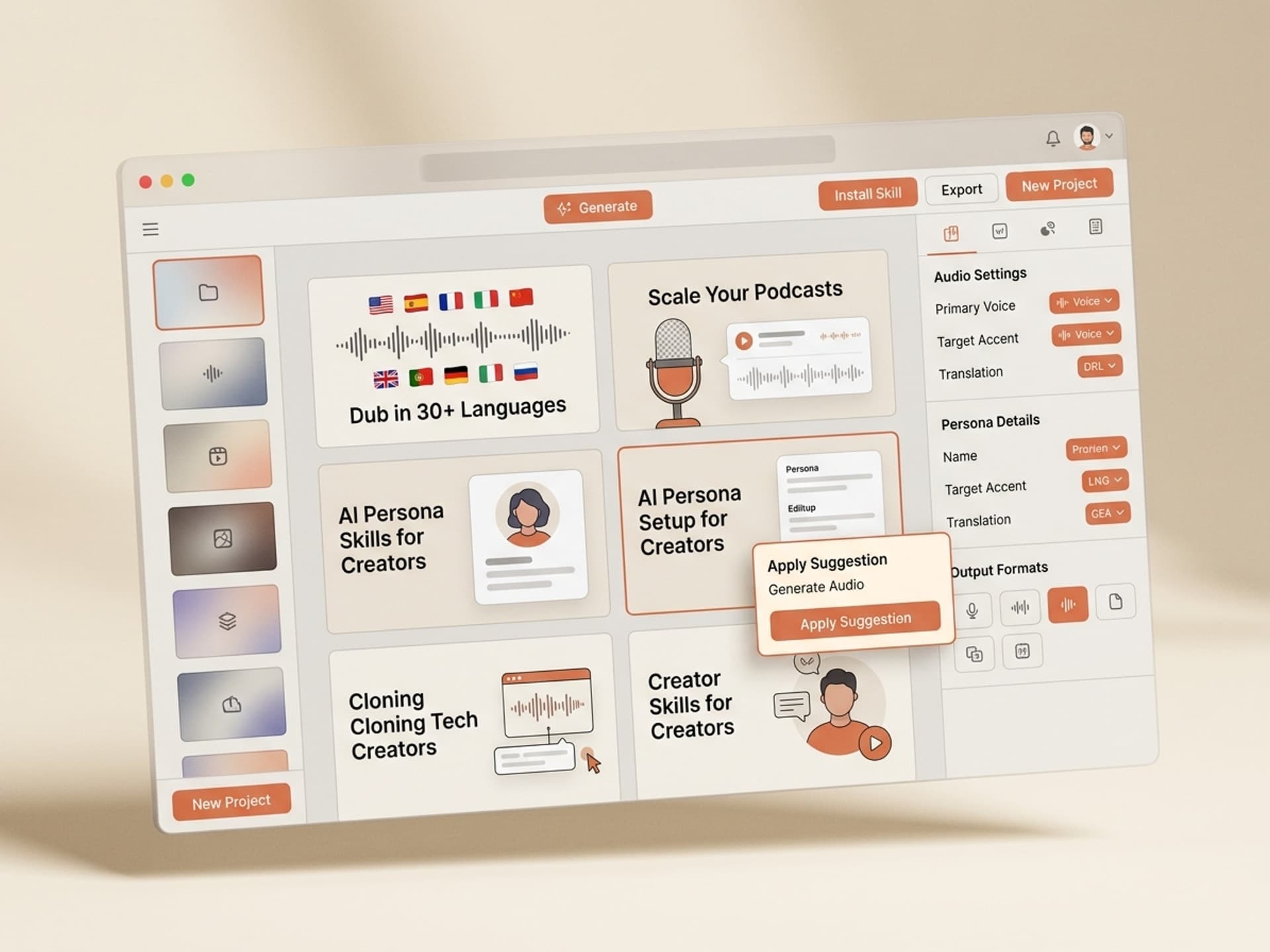

5 AI-stemmekloningsferdigheter på Vibe Skills

Hver av disse er en pakket arbeidsflyt - ikke bare en sjekkliste for oppsett. Installer én, koble til stemmeprøven din, og lever.

| Ferdighet | Best for | Hva den inkluderer |

|---|---|---|

| Multi-Language Video Dubber | YouTubere, kurskapere, sosiale videoer | Automatisk detektering av kildespråk, oversettelse, generering av dubbet spor med klonet stemme på over 30 målspråk, leppesynkronisering valgfritt |

| AI Persona Narrator Kit | Byggere av AI-influencere, skapere av virtuelle modeller | Fullt oppsett av stemmebibliotek, regler for merkevarestemme, intro / outro / hook-maler, forhåndsinnstillinger for innholdsfrekvens |

| Podcast AI Co-Host | Podkastere, skapere av lyd for nyhetsbrev | Klonet stemme + input av innholdsbeskrivelse, genererer annonselesninger, segmentoverganger, episodens sammendrag, sosiale sitatutdrag |

| Audiobook + Course Narrator | Kurskapere, uavhengige forfattere, undervisere | Batch-narration av lange manus med jevn rytme, deteksjon av kapittelbrudd, uttalsbibliotek for tekniske termer |

| Voice Identity Kit | Enslige skapere, frilansere, gründere | Setter opp klonet stemme + regler for merkevarestemme + 50 gjenbrukbare lydbiter (CTA-er, introer, taleposter, sosiale hooks) |

Alle fem finnes i kategorien AI Influencers på Vibe Skills, sammen med komplette identitetssett (ansikt, stemme, innholdspilarer). Abonnenter installerer ubegrenset med ferdigheter - så de fleste skapere stabler 2 - 3 av disse for sin persona.

Utforsk AI-influencer-ferdigheter på Vibe Skills →

Klon stemmen din på 30 minutter (trinn for trinn)

Her er den faktiske arbeidsflyten. Fra ende til ende, inkludert etisk oppsett, på under 30 minutter første gang.

Trinn 1: Velg riktig ferdighet på Vibe Skills

Åpne kategorien AI Influencers, velg arbeidsflyten som passer ditt bruksområde (Voice Identity Kit hvis du starter fra null, Multi-Language Video Dubber hvis du allerede publiserer video), og installer den. Hver ferdighet leveres med en oppsett-sjekkliste, en ElevenLabs-konfigurasjon og en mal for merkevarestemme.

Trinn 2: Spill inn stemmeprøven din

Du trenger 30 sekunder med ren lyd for en rask kloning, eller 30 minutter for en profesjonell kloning. Spill inn i et stille rom med en USB-mikrofon (en Samson Q2U til $79 er tilstrekkelig). Snakk naturlig - les et avsnitt, fortell en 90-sekunders historie, og ta deretter opp 5 forskjellige emosjonelle lesninger (spent, rolig, seriøs, vennlig, nysgjerrig).

Trinn 3: Last opp + tren stemmen

Ferdigheten guider deg gjennom ElevenLabs stemmeskaping: umiddelbar kloning for rask levering, profesjonell kloning for høyest mulig troskap. Trening tar mellom 30 sekunder (umiddelbar) og noen timer (profesjonell). Navngi stemmen din tydelig - "Elena Brand Voice 2026" - slik at biblioteket ditt forblir organisert.

Trinn 4: Sett regler for merkevarestemmen

Dette er trinnet alle skapere hopper over og alle skapere angrer på. Inne i ferdigheten fyller du ut en spesifikasjon for merkevarestemmen: rytme (sakte / naturlig / energisk), tone (varm, autoritativ, leken), fyllord som skal tillates eller blokkeres, uttalsregler for produktnavn. Ferdigheten lagrer disse reglene og bruker dem på hver gjengivelse.

Trinn 5: Generer ditt første ressurs

Velg formatet fra ferdigheten: dubbet videospor, podcast-intro, AI-persona Reels-manus, kurskapittel-narration. Lim inn teksten din, trykk render, og få en lydfil på sekunder. De fleste ferdigheter eksporterer direkte til MP3, WAV, eller en videofil med den nye lydsporet bakt inn.

Trinn 6: Legg til opplysningen

For alt utdata der seerne kan forveksle AI-stemmen med en menneskelig, legg til en opplysning. Ferdigheten leveres med opplysningmaler ("Denne lyden bruker en AI-stemmekloning av skaperen") og anbefalt plassering (video-beskrivelse, podcast-show notes, social caption). Dette er ikke valgfritt - se etikk-seksjonen nedenfor.

Trinn 7: Lever + gjenbruk

Lagre den gjengitte filen i biblioteket ditt. Ferdigheten beholder en versjonshistorikk slik at du kan gjengi det samme manuset på et nytt språk, bytte stemme, eller oppdatere manuset uten å miste stemmeinnstillingene. De fleste skapere setter opp et "stemmebibliotek" i Notion eller Frame.io og henter fra det for hver kampanje.

Etikk, samtykke og opplysning (delen alle hopper over)

Stemmekloning er den mest etisk belastede kategorien innen AI akkurat nå. Tre regler holder deg unna trøbbel - og på den rette siden av plattformens retningslinjer, regulatorer og publikum.

Klon kun din egen stemme. Eller få eksplisitt, skriftlig samtykke fra personen hvis stemme du kloner. FTC bøtela produsenten av en AI-stemmetjeneste $25M i 2024 for ikke-samtykkende stemmekloning. EU AI Act klassifiserer ikke-samtykkende stemmekloner som et system med høy risiko. Din podcast-gjest, din kollega, din favoritt-YouTuber - ingen av dem er tilgjengelig uten en signert tillatelse.

Opplys om AI-generert lyd. Legg til en klar merknad i videobeskrivelsen, podcast-show notes, eller social caption ("AI-stemmekloning av skaperen"). YouTubes regel for ansvarlig AI-merking trådte i kraft i 2024 og gjelder for enhver syntetisk stemme som kan forveksles med en ekte person. Meta og TikTok oppdager og merker nå AI-lyd automatisk - men å gjøre det selv ser mer troverdig ut enn å la plattformen gjøre det for deg.

Aldri utgi deg for å være ekte personer - spesielt offentlige personer. Å klone en politiker, en kjendis, eller en hvilken som helst ekte tredjepart for satire, reklame, eller personainnhold er en rask vei til en nedstengning, en injuriesak, eller verre. FCC-avgjørelsen fra 2024 gjør AI-genererte robocall med klonede politiske stemmer ulovlige i USA. Ikke gå i nærheten av det.

De gode nyhetene: hver legitime stemmekloningsferdighet på Vibe Skills bygger inn samtykkeverifisering, opplysningmaler og overholdelse av plattformens retningslinjer i arbeidsflyten. Det er en del av det du betaler for.

Ofte stilte spørsmål

Er AI-stemmekloning lovlig for skapere?

Ja - så lenge du bare kloner din egen stemme eller har skriftlig samtykke fra taleren. Å klone en offentlig person eller en tredjepart uten samtykke er ulovlig i de fleste jurisdiksjoner og et brudd på alle store plattformers vilkår for bruk. Ferdighetene på Vibe Skills leveres med samtykkemal og veiledning for opplysning for å holde deg i samsvar.

Hvor god er kvaliteten på AI-stemmekloning sammenlignet med mennesker i 2026?

Stemmekloner i toppklasse fra ElevenLabs og Vertex AI Chirp passerer blindtester med over 80% uadskillelighet for kortvarig lyd. For langvarig (30+ minutter uten avbrudd), har menneskelig narration fortsatt en liten fordel på emosjonell nyanse og pustekontroll - men gapet lukkes hvert kvartal. For de fleste skaperbruksområder (Reels, Shorts, podcast-introer, dubbing), er AI-kvaliteten god nok til at publikum ikke legger merke til det.

Kan jeg bruke stemmekloning for podcaster?

Ja, og det er en av bruksområdene med høyest ROI. Bruk en klonet stemme for annonselesninger, episodens introer, outroer, segmentoverganger og sitatutdrag - behold din ekte stemme for hovedinnholdet i intervjuet. Noen skapere bruker en full AI co-vert. Podcast AI Co-Host-ferdigheten på Vibe Skills håndterer hele stabelen: stemmekloning, input av beskrivelse, automatiserte segmenter og direkte eksport til din podcast-vert.

Hvor mye koster det å kjøre en stemmekloningsarbeidsflyt?

ElevenLabs priser starter på $5/måned for hobbybruk og skalerer til $99/måned for Creator-nivået (som de fleste profesjonelle skapere bruker). Et Vibe Skills-abonnement på Pro-planen koster $39/måned og inkluderer ubegrenset med stemmekloningsferdigheter pluss resten av katalogen. Total kostnad for en fungerende skaper: under $150/måned. Sammenlign det med én frilans dub-økt til $2 000+ og regnestykket er brutalt.

Vil publikum mitt bry seg om at jeg bruker AI-stemme?

De fleste vil ikke legge merke til det hvis arbeidsflyten er finjustert. Publikum bryr seg om tre ting i denne rekkefølgen: er innholdet bra, er skaperen autentisk, er det en opplysning. Opplys tydelig om AI-stemmen, og du beholder tilliten. Skjul det, og du mister publikum i det øyeblikket de finner ut av det - noe de vil. Studier fra 2025 viste at publikum straffer skjult AI-bruk 3 ganger hardere enn opplyst AI-bruk.

Hva er forskjellen mellom stemmekloning og AI-stemmeopplesning?

AI-stemmeopplesning bruker en standardstemme fra et bibliotek (ElevenLabs, OpenAI TTS, Google Cloud TTS). Stemmekloning genererer lyd med din stemme (eller en samtykkende talers stemme) fra en prøve. For merkevarekonsistens vinner stemmekloning. For engangs generell narration er standard AI-stemmeopplesning greit og litt billigere.

Kan jeg dubbe YouTube-videoene mine til andre språk med min egen stemme?

Ja - dette er #1 bruksområde i 2026. Multi-Language Video Dubber-ferdigheten på Vibe Skills tar din kildevideo, transkriberer lyden, oversetter den til målspråkene dine, og genererer dubbede spor med din klonede stemme på over 30 språk. YouTubes funksjon for lyd på flere språk lar deg laste opp alle sporene til én enkelt video slik at hver seer hører sitt eget språk automatisk.

Konklusjonen: Stemmen er den nye distribusjonskanalen

I 2026 utnytter alle skapere som ikke bruker stemmekloning en stor distribusjonskanal som ligger brakk. Rekkevidde på flere språk, daglig AI-personainnhold, podcast-skalering, kurs-narration - dette er ikke lenger eksperimentelt. Det er grunnlaget for seriøse skapere.

Det rette trekket er ikke å lære seg fem verktøy og koble dem sammen. Det er å installere én ferdighet som pakker inn arbeidsflyten, koble til stemmeprøven din, og levere. AI-stemmekloningsferdigheter på Vibe Skills håndterer ElevenLabs-oppsettet, reglene for merkevarestemme, dubbing-pipelinen, opplysningmalene og eksportformatene - slik at du forblir i skapermodus i stedet for operatørmodus.

Utforsk ferdigheter for stemmekloning + AI-persona på Vibe Skills →

Hopp over studioet. Lever med stemmen din, på alle språk. Installer en AI-stemmekloningsferdighet på Vibe Skills.