Dlulisa amehlo ezinkulumbeni zamakhono alungile we-Claude, Cursor, nokunye okwengeziwe.

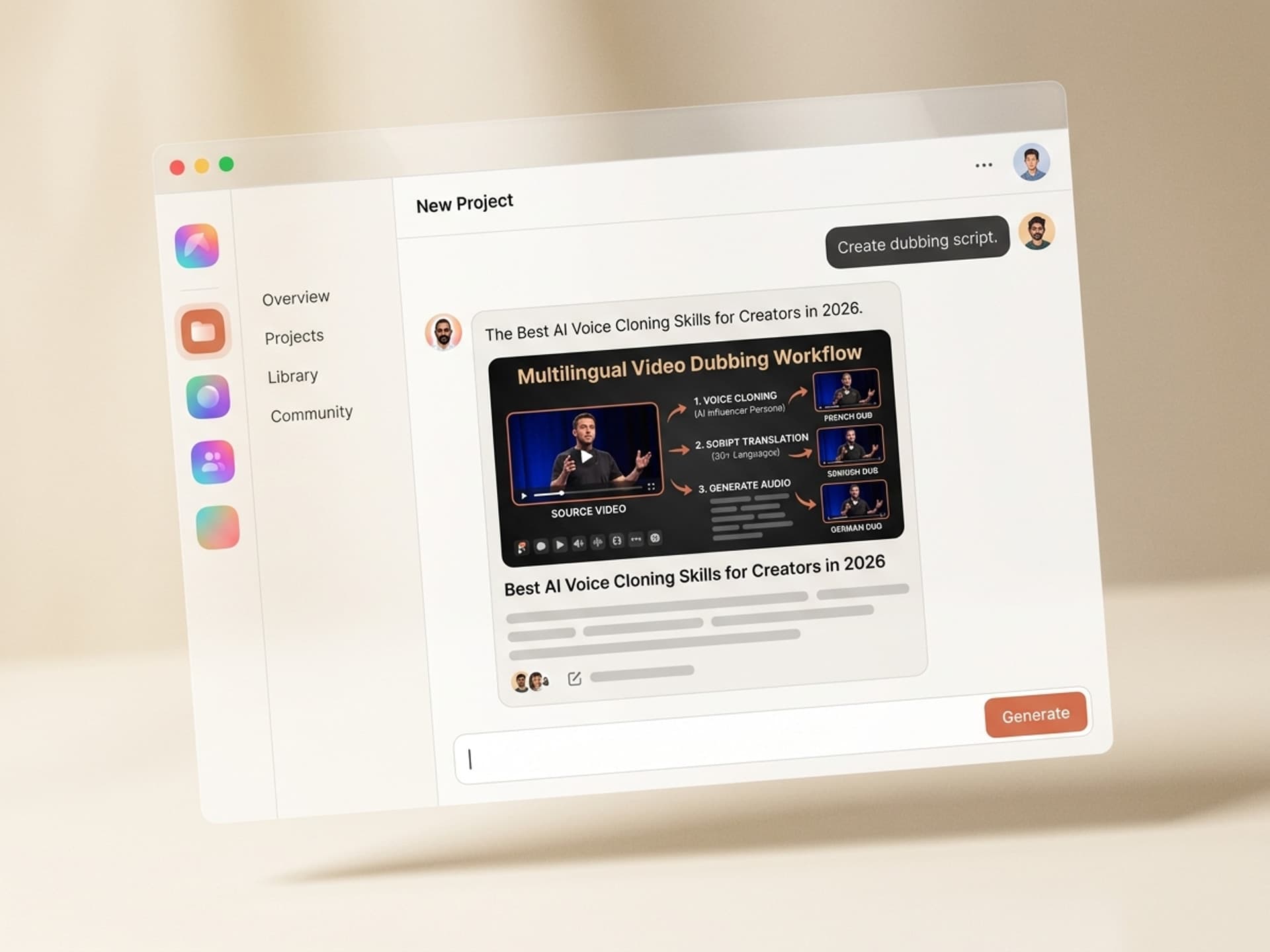

Die besten KI-Stimmklon-Fähigkeiten für Kreative im Jahr 2026

KI-Stimmklonen ermöglicht es einem Kreativen, in über 30 Sprachen zu veröffentlichen, tägliche KI-Persona-Inhalte zu liefern und einen Podcast in eine 24/7-Produktionslinie zu verwandeln - anhand einer 30-sekündigen Aufnahme der eigenen Stimme. ElevenLabs führt den kommerziellen Markt mit Latenzzeiten unter einer Sekunde und über 70 Sprachen an, aber der Workflow drumherum (Bibliothekseinrichtung, Synchronisation, Konsistenz der Markenstimme, Offenlegung von Ethikrichtlinien) ist auf fünf Tools fragmentiert. KI-Stimmklon-Fähigkeiten bündeln die gesamte Pipeline in einer einzigen Installation, sodass Kreative aufhören, Tools miteinander zu verbinden, und mit der Veröffentlichung beginnen können. Der schnellste Weg, loszulegen, ist, eine fertige Stimmfähigkeit von Vibe Skills zu erwerben.

Dies ist ein Leitfaden für Kreative, kein Sammelsurium von Werkzeugen. Echte Podcaster, YouTuber und KI-Persona-Entwickler nutzen Stimmklone, um mehr Inhalte in mehr Sprachen zu veröffentlichen, ohne ein Studio anheuern zu müssen - und die Lücke zwischen „Early Adopter“ und „alle machen das“ schließt sich schnell.

Dlulisa amehlo ezinkulumbeni zamakhono alungile we-Claude, Cursor, nokunye okwengeziwe.

Warum die Stimme der Engpass für das Wachstum von KI-Personas ist

Für die meisten Kreativen ist die visuelle Seite von KI-Inhalten gelöst. Bild- und Videomodelle erreichten 2025 fotorealistische Qualität. Aber die Stimme ist es, die einer Persona Echtheit verleiht - und die Stimme ist es, wo der Workflow zusammenbricht.

Der Engpass zeigt sich an drei Stellen:

- Produktionsgeschwindigkeit. Die Aufnahme von 20 Minuten sauberem Voiceover dauert 60 - 90 Minuten Studiozeit, wenn man Einrichtung, Wiederholungen und Bearbeitung berücksichtigt. Multiplizieren Sie das mit täglichen Shorts, und die Woche ist vorbei.

- Sprachreichweite. Ein Kreativer, der nur Englisch spricht, begrenzt seinen TAM auf etwa 1,5 Milliarden Menschen. Mit synchronisierten Audiospuren in 10 Sprachen steigt diese Zahl auf über 5 Milliarden potenzielle Zuschauer. YouTube setzt seit Ende 2024 stark auf mehrsprachige Audiospuren - MrBeasts synchronisierte Kanäle erzielen kollektiv mehr Aufrufe als sein englischer Kanal.

- Persona-Konsistenz. KI-Personas benötigen eine Stimme, die am Dienstag genauso klingt wie drei Monate zuvor. Die Anstellung eines Synchronsprechers für eine tägliche KI-Figur kostet 300 - 800 US-Dollar pro Sitzung, und sie brechen die Vereinbarung, sobald sie krank werden oder ihre Preise erhöhen.

ElevenLabs berichtete allein 2024 von 2,5 Millionen geklonten Stimmen auf seiner Plattform. Der Markt wird bis 2032 voraussichtlich 5,4 Milliarden US-Dollar erreichen und mit einer jährlichen Wachstumsrate von 26 % wachsen. Der Grund ist einfach: Stimmklonen reduziert die Kosten für die Audioproduktion von „Studio-Session“ auf „API-Aufruf“, während das Ergebnis in Blindtests von menschlicher Stimme nicht zu unterscheiden ist.

Was fehlt, ist die Workflow-Schicht über dem Modell - und hier kommen KI-Fähigkeiten ins Spiel.

Dlulisa amehlo ezinkulumbeni zamakhono alungile we-Claude, Cursor, nokunye okwengeziwe.

Anwendungsfälle für Stimmklonen für Kreative

Stimmklonen ist keine einzelne Funktion. Es ist ein Stapel von Anwendungsfällen, die sich vervielfachen, wenn man sie zusammenführt. Hier werden Kreative im Jahr 2026 tatsächlich bezahlt:

| Anwendungsfall | Was es ersetzt | Zeitersparnis |

|---|---|---|

| Mehrsprachige Video-Synchronisation | 2.000 - 5.000 US-Dollar pro Sprache pro Stunde mit einem menschlichen Studio | Ein 10-minütiges Video in 8 Sprachen in weniger als 30 Minuten übersetzen und synchronisieren |

| KI-Persona-Narration | 300 - 800 US-Dollar pro Sprechersitzung, über 30.000 US-Dollar pro Jahr für tägliche Inhalte | 30 Tage KI-Persona-Reels an einem Nachmittag veröffentlichen |

| Podcast-Assistentenstimme | Ein zweiter Moderator oder Produzent (über 50.000 US-Dollar pro Jahr) | Intros, Outros, Werbespots und Segmentübergänge nach Bedarf generieren |

| Hörbuch- + Kurs-Narration | 200 - 400 US-Dollar pro fertige Stunde für einen freiberuflichen Erzähler | Einen 6-stündigen Kurs in einer einzigen Stapelverarbeitung rendern |

| Audioversionen von Newslettern | Audio komplett überspringen (die meisten Kreativen tun das) | Automatisch einen Podcast-Feed aus jedem Newsletter-Beitrag generieren |

| Personalisierung von Live-Events | Generische voraufgezeichnete Voicemails | 1.000 personalisierte Audiobotschaften in eigener Stimme an Teilnehmer senden |

Die Wirtschaftlichkeit kehrt sich beim zweiten Anwendungsfall um. Ein Kreativer, der allein Synchronisation betreibt, macht schnell kostendeckend. Ein Kreativer, der Synchronisation + Persona + Podcast + Kurs-Narration mit derselben Stimmbibliothek betreibt, macht den gesamten KI-Stack in einem einzigen Shorts-Zyklus wett.

Der Haken ist operativ, nicht technisch. Die meisten Kreativen versuchen, ElevenLabs + ein Übersetzungstool + einen Videoeditor + eine Podcast-Plattform manuell zu verbinden - und geben nach zwei Wochen auf. KI-Fähigkeiten lösen das.

KI-Influencer-Fähigkeiten auf Vibe Skills durchsuchen →

Die Landschaft der Stimmklon-Tools im Jahr 2026

Kurzer Kontext zu den zugrunde liegenden Tools, damit die Empfehlungen für Fähigkeiten Sinn ergeben. Kreative müssen nicht all diese lernen - die Fähigkeiten bündeln sie.

| Tool | Am besten geeignet für | Sprachen | Qualität des Stimmklons |

|---|---|---|---|

| ElevenLabs | Höchste Wiedergabetreue, Podcast- und Persona-Arbeit | 70+ | Branchenführer. Sofortiger Klon aus 30 Sekunden, professioneller Klon aus 30 Minuten |

| Descript Overdub | Bearbeitung bestehender Aufnahmen, Podcast-Bereinigung | Englisch zuerst | Gut für Korrekturen, schwächer für vollständige Generierung |

| OpenAI Voice Engine | Konversationelle KI, Langform-Antworten | 50+ | Hohe Qualität, eingeschränkter Zugriff (Warteliste) |

| Google Vertex AI / Chirp | Unternehmenssynchronisation, YouTube-Autodub | 100+ | Stark bei Akzentübertragung, schwächer bei emotionaler Nuancierung |

| Resemble AI | Echtzeit-Stimmklonen, Spiele, NPCs | 60+ | Starke Echtzeit-API, in interaktiven Produkten verwendet |

ElevenLabs ist 2026 der Standard für Kreative. Es erreichte 2025 Latenzzeiten unter 300 ms, unterstützt Stimmklonen aus einer 30-sekündigen Aufnahme und liefert jetzt native mehrsprachige Synchronisationen, die die Stimme des Sprechers über Sprachen hinweg bewahren. Die meisten KI-Stimmklon-Fähigkeiten auf dem Marktplatz verwenden ElevenLabs als primäre Engine und ergänzen die Workflow-Schicht.

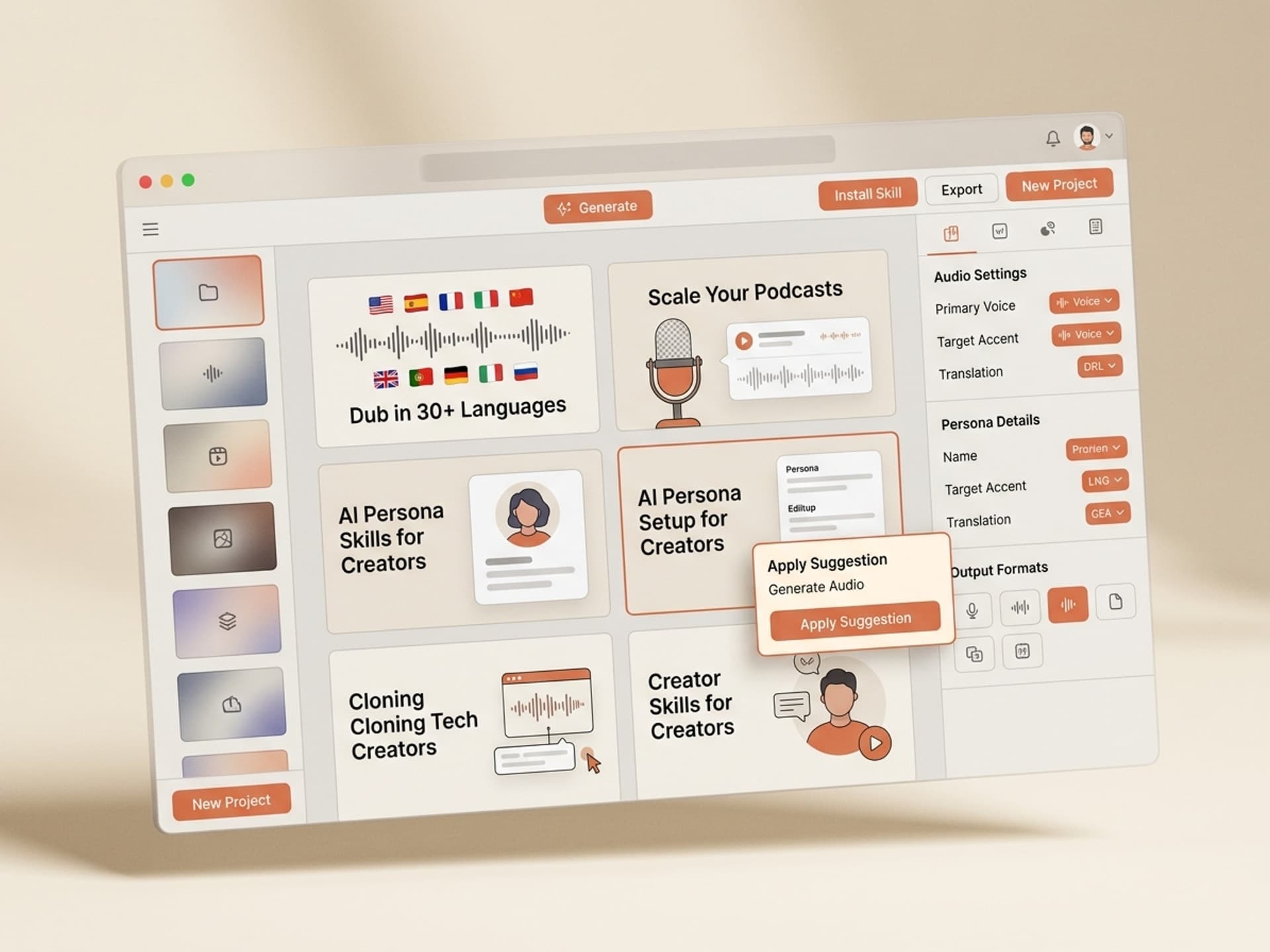

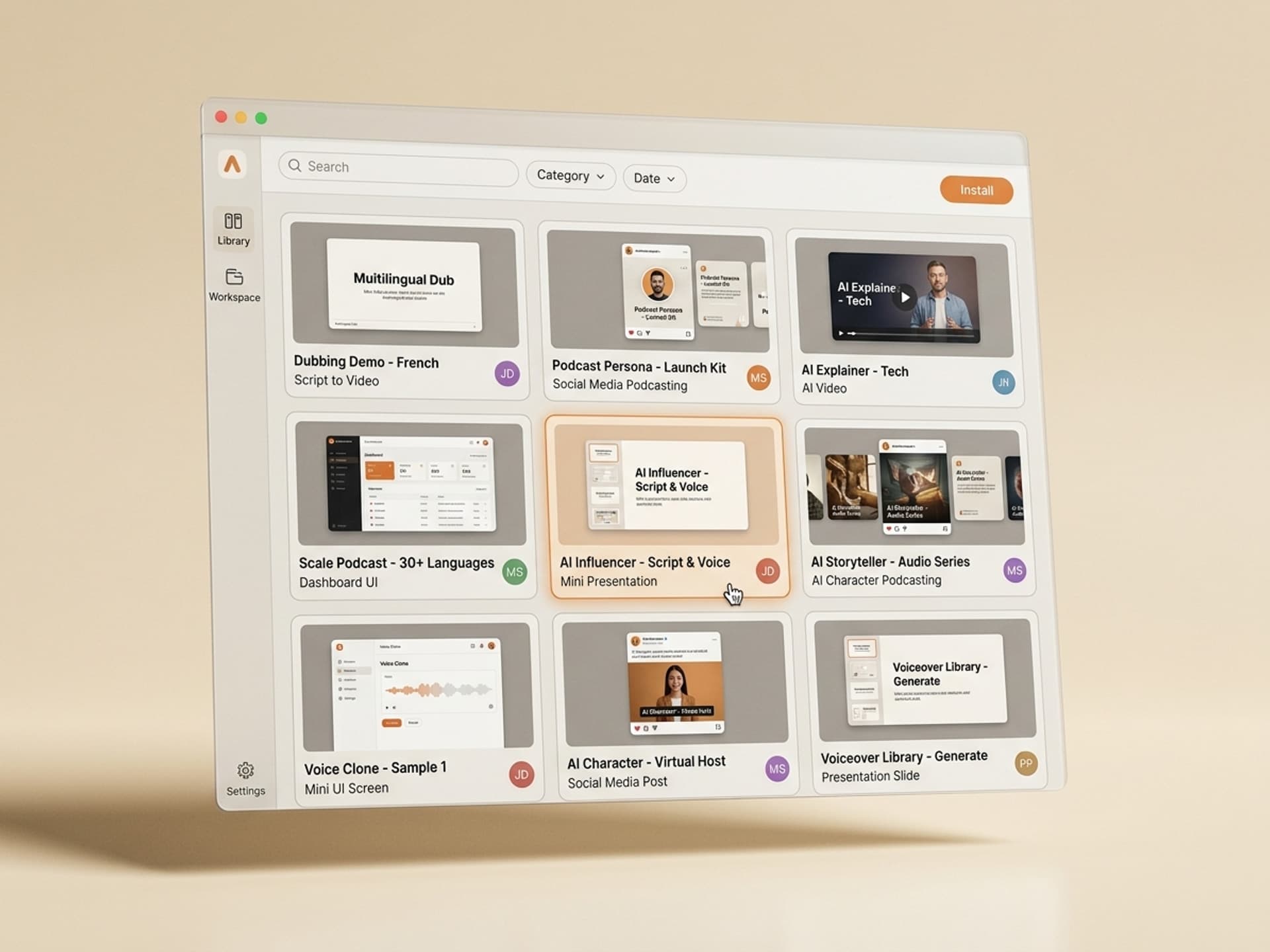

5 KI-Stimmklon-Fähigkeiten auf Vibe Skills

Jede dieser Fähigkeiten ist ein gebündelter Workflow - nicht nur eine Einrichtungscheckliste. Installieren Sie eine, stecken Sie Ihre Stimmprobe ein und veröffentlichen Sie.

| Fähigkeit | Am besten geeignet für | Was es beinhaltet |

|---|---|---|

| Multi-Language Video Dubber | YouTuber, Kursentwickler, Social-Video-Ersteller | Automatische Erkennung der Quellsprache, Übersetzung, Generierung einer synchronisierten Spur in Ihrer geklonten Stimme für über 30 Zielsprachen, Lippen-Synchronisation optional |

| AI Persona Narrator Kit | KI-Influencer-Ersteller, virtuelle Model-Ersteller | Vollständige Einrichtung der Stimmbibliothek, Markenstimmenregeln, Vorlagen für Intros/Outros/Hooks, Voreinstellungen für die Content-Kadenz |

| Podcast AI Co-Host | Podcaster, Ersteller von Newsletter-Audios | Geklonte Stimme + Eingabe von Inhaltsbriefings, generiert Werbespots, Segmentübergänge, Episoden-Zusammenfassungen, Social-Pull-Quotes |

| Audiobook + Course Narrator | Kursentwickler, Indie-Autoren, Pädagogen | Stapelweise Erzählung von Langform-Skripten mit konsistentem Tempo, Erkennung von Kapitelgrenzen, Aussprachebibliothek für Fachbegriffe |

| Voice Identity Kit | Solo-Kreative, Freiberufler, Gründer | Richtet geklonte Stimme + Markenstimmenregeln + 50 wiederverwendbare Audio-Snippets (CTAs, Intros, Voicemails, Social Hooks) ein |

Alle fünf befinden sich in der Kategorie „AI Influencers“ auf Vibe Skills, zusammen mit vollständigen Identitäts-Kits (Gesicht, Stimme, Content-Säulen). Abonnenten installieren unbegrenzt viele Fähigkeiten - daher stapeln die meisten Kreativen 2 - 3 davon für ihre Persona.

KI-Influencer-Fähigkeiten auf Vibe Skills durchsuchen →

Klonen Sie Ihre Stimme in 30 Minuten (Schritt für Schritt)

Hier ist der tatsächliche Workflow. End-to-End, einschließlich der Einrichtung der Ethikrichtlinien, beim ersten Mal in unter 30 Minuten.

Schritt 1: Wählen Sie die richtige Fähigkeit auf Vibe Skills

Öffnen Sie die Kategorie „AI Influencers“, wählen Sie den Workflow, der zu Ihrem Anwendungsfall passt (Voice Identity Kit, wenn Sie bei Null anfangen, Multi-Language Video Dubber, wenn Sie bereits Videos veröffentlichen), und installieren Sie ihn. Jede Fähigkeit wird mit einer Einrichtungscheckliste, einer ElevenLabs-Konfiguration und einer Markenstimmenvorlage geliefert.

Schritt 2: Nehmen Sie Ihre Stimmprobe auf

Sie benötigen 30 Sekunden sauberes Audio für einen schnellen Klon oder 30 Minuten für einen professionellen Klon. Nehmen Sie in einem ruhigen Raum mit einem USB-Mikrofon auf (ein Samson Q2U für 79 US-Dollar reicht aus). Sprechen Sie natürlich - lesen Sie einen Absatz, erzählen Sie eine 90-sekündige Geschichte und nehmen Sie dann 5 verschiedene emotionale Lesungen auf (aufgeregt, ruhig, ernst, freundlich, neugierig).

Schritt 3: Laden Sie die Stimme hoch und trainieren Sie sie

Die Fähigkeit führt Sie durch die Erstellung einer ElevenLabs-Stimme: Sofortiger Klon für schnelle Bearbeitungszeiten, professioneller Klon für höchste Wiedergabetreue. Das Training dauert zwischen 30 Sekunden (sofort) und einigen Stunden (professionell). Benennen Sie Ihre Stimme klar - „Elena Markenstimme 2026“ - , damit Ihre Bibliothek organisiert bleibt.

Schritt 4: Legen Sie die Markenstimmenregeln fest

Dies ist der Schritt, den jeder Kreative überspringt und jeder Kreative bereut. Innerhalb der Fähigkeit füllen Sie eine Markenstimmen-Spezifikation aus: Tempo (langsam/natürlich/energetisch), Tonlage (warm, autoritativ, verspielt), Füllwörter, die zugelassen oder blockiert werden sollen, Ausspracheregeln für Produktnamen. Die Fähigkeit speichert diese Regeln und wendet sie auf jeden Render an.

Schritt 5: Generieren Sie Ihr erstes Asset

Wählen Sie das Format aus der Fähigkeit: synchronisierte Videospur, Podcast-Intro, KI-Persona-Reels-Skript, Kurskapitel-Narration. Fügen Sie Ihren Text ein, klicken Sie auf Render, erhalten Sie eine Audiodatei in Sekunden. Die meisten Fähigkeiten exportieren direkt nach MP3, WAV oder eine Videodatei mit der neuen Audiospur.

Schritt 6: Fügen Sie die Offenlegung hinzu

Für alle Ausgaben, bei denen Betrachter die KI-Stimme mit einer menschlichen verwechseln könnten, fügen Sie eine Offenlegung hinzu. Die Fähigkeit wird mit Vorlagen für Offenlegungen geliefert („Dieses Audio verwendet eine KI-Stimmkopie des Erstellers“) und der empfohlenen Platzierung (Videobeschreibung, Podcast-Shownotes, Social-Caption). Dies ist nicht optional - siehe unten den Abschnitt über Ethik.

Schritt 7: Veröffentlichen und wiederverwenden

Speichern Sie die gerenderte Datei in Ihrer Bibliothek. Die Fähigkeit behält eine versionierte Historie, sodass Sie dasselbe Skript in einer neuen Sprache erneut rendern, die Stimme ändern oder das Skript aktualisieren können, ohne die stimmeneinstellungen zu verlieren. Die meisten Kreativen richten eine „Stimmbibliothek“ in Notion oder Frame.io ein und greifen für jede Kampagne darauf zu.

Ethik, Zustimmung und Offenlegung (Der Teil, den jeder überspringt)

Stimmklonen ist derzeit die ethisch heikelste Kategorie in der KI. Drei Regeln halten Sie aus Schwierigkeiten heraus - und auf der richtigen Seite von Plattformrichtlinien, Regulierungsbehörden und Ihrem Publikum.

Klonen Sie nur Ihre eigene Stimme. Oder holen Sie sich die ausdrückliche, schriftliche Zustimmung der Person, deren Stimme Sie klonen. Die FTC verhängte 2024 eine Geldstrafe von 25 Millionen US-Dollar gegen den Hersteller eines KI-Stimm-Services wegen nicht einvernehmlicher Stimmklone. Der EU AI Act stuft nicht einvernehmliche Stimmklone als Hochrisikosystem ein. Ihr Podcast-Gast, Ihr Kollege, Ihr Lieblings-YouTuber - keiner von ihnen ist ohne eine unterzeichnete Freigabe frei verfügbar.

Geben Sie KI-generierte Audios offen. Fügen Sie eine klare Notiz in die Videobeschreibung, die Podcast-Shownotes oder die Social-Caption ein („KI-Stimmkopie des Erstellers“). YouTubes Regel zur Kennzeichnung verantwortungsbewusster KI wurde 2024 live geschaltet und gilt für jede synthetische Stimme, die mit einer echten Person verwechselt werden könnte. Meta und TikTok erkennen und kennzeichnen KI-Audio jetzt automatisch - aber es selbst zu tun, wirkt glaubwürdiger, als es der Plattform zu überlassen.

Impersonieren Sie niemals echte Personen - insbesondere keine öffentlichen Figuren. Das Klonen eines Politikers, einer Berühmtheit oder eines beliebigen echten Dritten für Satire, Werbung oder Persona-Inhalte ist ein schneller Weg zu einer Sperrung, einem Verleumdungsprozess oder Schlimmerem. Die Entscheidung der FCC im Jahr 2024 macht KI-generierte Robocalls mit geklonten politischen Stimmen in den USA illegal. Gehen Sie nicht in diese Richtung.

Die gute Nachricht: Jede legitime KI-Stimmklon-Fähigkeit auf Vibe Skills integriert die Überprüfung der Zustimmung, Vorlagen für Offenlegungen und die Einhaltung von Plattformrichtlinien in den Workflow. Das ist Teil dessen, wofür Sie bezahlen.

Häufig gestellte Fragen

Ist KI-Stimmklonen für Kreative legal?

Ja - solange Sie nur Ihre eigene Stimme klonen oder die schriftliche Zustimmung des Sprechers haben. Das Klonen einer öffentlichen Figur oder eines Dritten ohne Zustimmung ist in den meisten Gerichtsbarkeiten illegal und ein Verstoß gegen die Nutzungsbedingungen aller wichtigen Plattformen. Die Fähigkeiten auf Vibe Skills werden mit Zustimmungsvorlagen und Offenlegungsanleitungen geliefert, um Sie konform zu halten.

Wie gut ist die Qualität von KI-Stimmklonen im Vergleich zu menschlichen im Jahr 2026?

Erstklassige Stimmklone von ElevenLabs und Vertex AI Chirp bestehen Blindtests mit über 80 % Ununterscheidbarkeit für Kurzform-Audio. Für Langform-Audio (über 30 Minuten ununterbrochen) hat menschliche Erzählung immer noch einen leichten Vorteil bei emotionaler Nuancierung und Atemkontrolle - aber die Lücke schließt sich jedes Quartal. Für die meisten Anwendungsfälle von Kreativen (Reels, Shorts, Podcast-Intros, Synchronisation) ist die KI-Qualität gut genug, dass die Zielgruppe es nicht bemerkt.

Kann ich Stimmklonen für Podcasts verwenden?

Ja, und es ist einer der Anwendungsfälle mit dem höchsten ROI. Verwenden Sie eine geklonte Stimme für Werbespots, Episoden-Intros, Outros, Segmentübergänge und Pull-Quotes - behalten Sie Ihre echte Stimme für die Hauptinhalte des Interviews. Einige Kreative nutzen einen vollwertigen KI-Co-Host. Die Fähigkeit „Podcast AI Co-Host“ auf Vibe Skills kümmert sich um den gesamten Stack: Stimmklon, Brief-Eingabe, automatisierte Segmente und direkter Export zu Ihrem Podcast-Host.

Wie viel kostet die Durchführung eines Stimmklon-Workflows?

Die Preise von ElevenLabs beginnen bei 5 US-Dollar pro Monat für Hobby-Nutzung und skalieren auf 99 US-Dollar pro Monat für die Creator-Stufe (die die meisten Pro-Kreativen nutzen). Ein Vibe Skills-Abonnement auf dem Pro-Plan kostet 39 US-Dollar pro Monat und beinhaltet unbegrenzte KI-Stimmklon-Fähigkeiten plus den Rest des Katalogs. Die Gesamtkosten für einen arbeitenden Kreativen: unter 150 US-Dollar pro Monat. Vergleichen Sie das mit einer einzigen Freiberufler-Synchronisationssitzung für über 2.000 US-Dollar, und die Rechnung ist brutal.

Wird mein Publikum es stören, dass ich KI-Stimme verwende?

Die meisten werden es nicht bemerken, wenn der Workflow optimiert ist. Das Publikum kümmert sich in dieser Reihenfolge um drei Dinge: Sind die Inhalte gut, ist der Ersteller authentisch, gibt es eine Offenlegung. Offenbaren Sie die KI-Stimme klar und Sie bewahren das Vertrauen. Verbergen Sie sie, und Sie verlieren das Publikum, sobald sie es herausfinden - was sie tun werden. Studien aus dem Jahr 2025 ergaben, dass Zielgruppen versteckte KI-Nutzung dreimal härter bestrafen als offengelegte KI-Nutzung.

Was ist der Unterschied zwischen Stimmklonen und KI-Voiceover?

KI-Voiceover verwendet eine Stock-Stimme aus einer Bibliothek (ElevenLabs, OpenAI TTS, Google Cloud TTS). Stimmklonen generiert Audio in Ihrer Stimme (oder der Stimme eines zustimmenden Sprechers) aus einer Probe. Für Markenkonformität gewinnt das Stimmklonen. Für einmalige generische Erzählungen ist Stock-KI-Voiceover in Ordnung und etwas günstiger.

Kann ich meine YouTube-Videos mit meiner eigenen Stimme in andere Sprachen synchronisieren?

Ja - dies ist 2026 der Hauptanwendungsfall. Die Fähigkeit „Multi-Language Video Dubber“ auf Vibe Skills nimmt Ihr Quellvideo, transkribiert das Audio, übersetzt es in Ihre Zielsprachen und generiert synchronisierte Spuren in Ihrer geklonten Stimme in über 30 Sprachen. YouTubes Funktion für mehrsprachige Audio ermöglicht es Ihnen, alle Spuren zu einem einzigen Video hochzuladen, sodass jeder Zuschauer automatisch seine eigene Sprache hört.

Das Fazit: Stimme ist der neue Vertriebskanal

Im Jahr 2026 lässt jeder Kreative, der keine Stimmklonung nutzt, einen wichtigen Vertriebskanal liegen. Mehrsprachige Reichweite, tägliche KI-Persona-Inhalte, Podcast-Skalierung, Kurs-Narration - diese sind nicht mehr experimentell. Sie sind die Basis für ernsthafte Kreative.

Der richtige Schritt ist nicht, fünf Tools zu lernen und sie zu verbinden. Es ist, eine Fähigkeit zu installieren, die den Workflow bündelt, Ihre Stimmprobe einzuspielen und zu veröffentlichen. KI-Stimmklon-Fähigkeiten auf Vibe Skills kümmern sich um die ElevenLabs-Einrichtung, die Markenstimmenregeln, die Synchronisationspipeline, die Offenlegungs-Vorlagen und die Exportformate - damit Sie im Kreativmodus bleiben und nicht im Operator-Modus.

Stimmklon- + KI-Persona-Fähigkeiten auf Vibe Skills durchsuchen →

Überspringen Sie das Studio. Veröffentlichen Sie in Ihrer Stimme, in jeder Sprache. Installieren Sie eine KI-Stimmklon-Fähigkeit auf Vibe Skills.